智能体记忆系统使大语言模型(LLM)智能体能够在长时交互中保持状态,从而支持超越固定上下文窗口的长程推理与个性化功能。尽管架构发展迅速,但这些系统的实证基础仍显薄弱:现有基准测试规模通常不足,评估指标与语义效用(Semantic Utility)存在偏离,不同基座模型间的性能表现差异显著,且系统级成本往往被忽视。本综述从架构与系统两个维度对智能体记忆进行了结构化分析。首先,我们根据四种记忆结构,提出了内存增强型生成(MAG)系统的简洁分类体系。随后,我们分析了制约当前系统的关键痛点,包括基准测试饱和效应、指标有效性与评判器敏感度、依赖于基座模型的准确率,以及记忆维护带来的延迟与吞吐量开销。通过建立记忆结构与实证局限性之间的联系,本综述阐明了当前智能体记忆系统往往难以达到其理论预期的原因,并为实现更可靠的评估与可扩展系统设计指明了方向。

1 引言

大语言模型(LLM)智能体正日益被期望能够在长时间跨度内运行,以维持用户偏好、积累任务相关知识等(Brown et al., 2020; Achiam et al., 2023; Wei et al., 2022)。然而,固定的上下文窗口从根本上限制了它们保留和操作持久化状态的能力(Brown et al., 2020; Beltagy et al., 2020; Liu et al., 2024; Press et al., 2021)。为了解决这一约束,**内存增强型生成(Memory-Augmented Generation, MAG)**将记忆扩展到了提示词(Prompt)之外,使智能体能够在跨交互过程中存储、检索和更新信息(Xu et al., 2025c; Nan et al., 2025; Chhikara et al., 2025; Jiang et al., 2026a; Liu et al., 2026)。尽管这一范式已迅速从轻量级语义存储演进到以实体为中心、反思型及层级化的设计,但实证研究依然有限:报告的性能提升在不同基准测试中表现不一,高度依赖于基座模型,且在评估和系统级成本方面缺乏原则性的指导。

这些挑战部分源于设计权衡的不明确以及评估手段的不完善。基准测试相对于现代上下文窗口而言规模往往偏小;评估指标更强调表面重叠而非语义效用;延迟和吞吐量下降等系统级成本也鲜有衡量。结果导致,复杂的记忆系统经常在简单的全上下文或检索基线(Baselines)即可胜任的场景中进行测试,从而掩盖了其真实的优势与局限。

在本文中,我们从架构和实证两个视角对智能体记忆系统进行了结构化分析。 1. 分类体系:我们提出了一个围绕四种记忆结构组织的 MAG 简洁分类体系:轻量级语义型、以实体为中心与个性化型、情节与反思型、以及结构化与层级化型。该分类体系根据记忆的组织和操作方式进行定义,为分析系统行为奠定了原则性基础。 1. 瓶颈识别:基于此框架,我们识别了限制系统可靠性与可扩展性的关键瓶颈,包括基准测试饱和、指标失配(如 F1 分数 vs. 语义正确性)、LLM 评判器评估中的提示词敏感性、基座模型依赖性,以及检索延迟、更新开销和吞吐量下降等系统级成本。

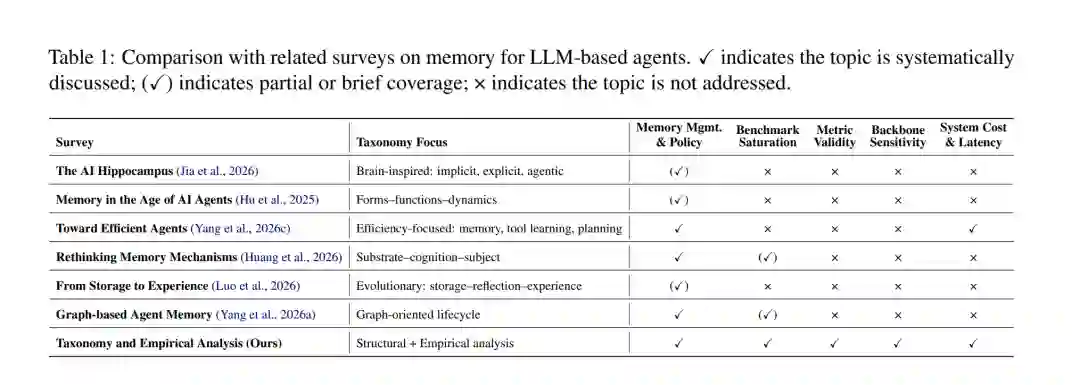

通过将记忆结构与实证局限性挂钩,本综述阐明了当前智能体记忆系统为何往往难以兑现其理论上的承诺。我们并非推崇单一的“最佳”设计,而是提供了一个诊断框架,用以解释特定记忆结构在何时有效、何时失效以及它们涉及的权衡。我们的分析为设计更鲁棒的基准测试、更可靠的评估协议以及更具扩展性的智能体记忆系统提供了指导。 与其他综述的区别:现有的综述(Jia et al., 2026; Hu et al., 2025; Yang et al., 2026c,a; Luo et al., 2026; Huang et al., 2026)主要在理论层面运行,通过编目架构、定义概念分类和类比认知科学来开展研究;而本综述则填补了从理论到实践的空白。我们的分类体系是以“结构”为导向的,不仅讨论了各种记忆结构的设计,还强调了记忆管理框架和优化策略。此外,我们在多个基准测试中提供了全面的评估。具体而言,我们对智能体记忆系统在基准测试饱和、指标有效性、基座敏感性和维护开销方面进行了系统分析,这些因素在以往的综述中被忽视,但对于理解当前 MAG 系统为何往往达不到理论预期至关重要。详细对比见表 1。