大语言模型(LLM)智能体的构建方式正经历变革:其重心已逐渐从修改模型权重转向围绕模型重构运行时系统(Runtime)。早期系统期望模型在内部实现的各项能力,如今正被外部化(Externalized)为存储模块、可复用技能、交互协议,以及确保这些模块在实际应用中可靠运行的外围支撑框架(Harness)。 本文通过“外部化”这一视角对上述转型进行了综述。借鉴认知人工制品(Cognitive artifacts)的概念,我们认为智能体基础设施的重要性不仅在于引入了辅助组件,更在于它将沉重的认知负担转化为模型能够更可靠处理的形式。在此视角下:内存实现了跨时间的决策状态外部化;技能实现了程序化专业知识的外部化;协议实现了交互结构的外部化;而框架工程则作为统一层,协调上述组件进行受控执行。

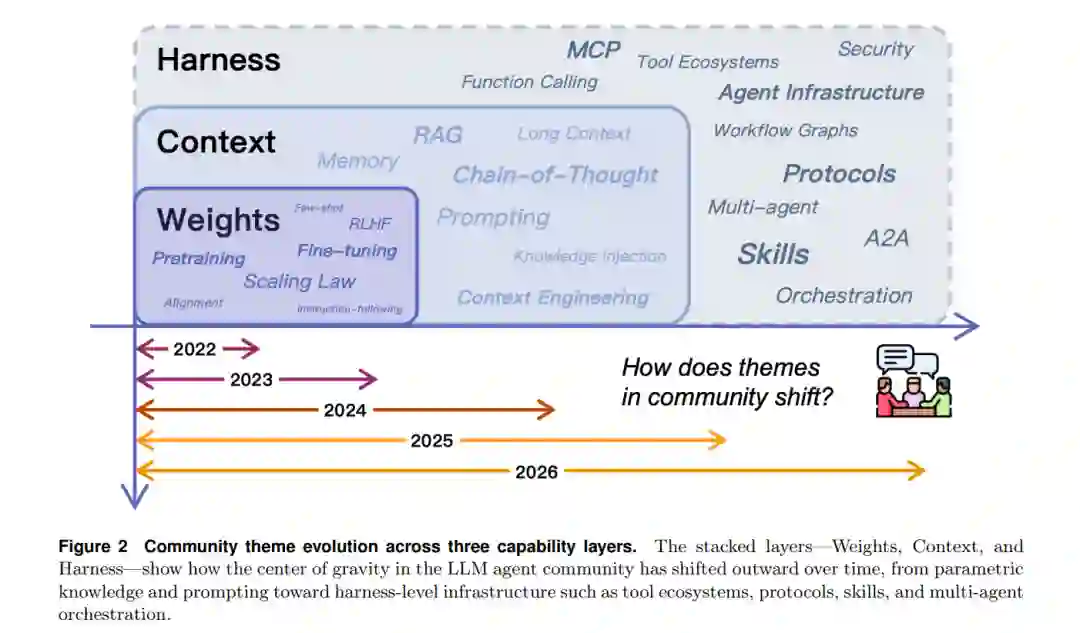

我们追溯了从“权重”到“上下文”再到“框架”的历史演进过程;分析了内存、技能与协议作为三种独立且耦合的外部化形式及其在大型智能体系统内部的相互作用。此外,本文进一步讨论了参数化能力与外部化能力之间的权衡,识别了诸如自进化框架和共享智能体基础设施等新兴方向,并探讨了在评估、治理以及模型与外部基础设施长期协同演化方面面临的开放挑战。最终,本文提出了一个系统级框架,用以解释为何实际的智能体进展日益依赖于更优越的外部认知基础设施,而非仅仅依赖于更强大的模型。

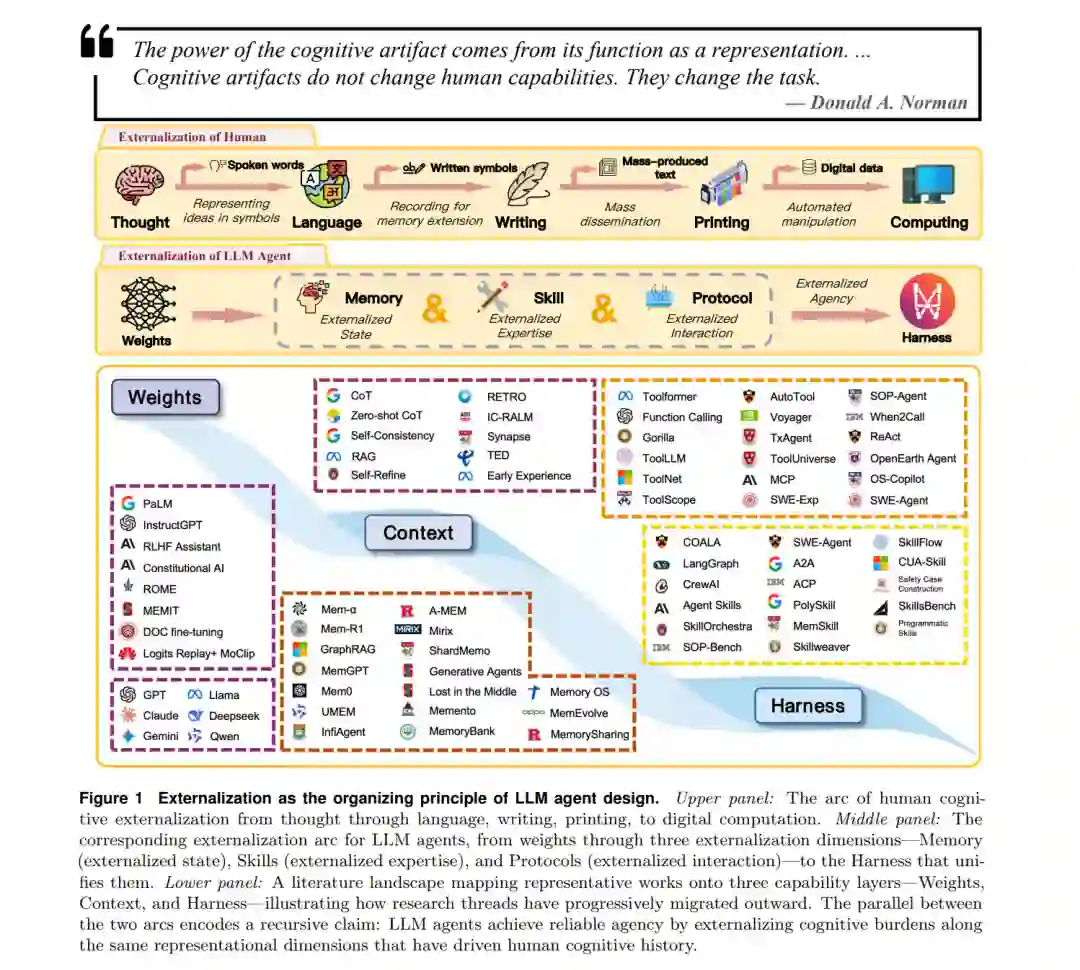

人类文明史亦可被视为一部认知外部化的历史。口头语言将私密思想转化为可共享的符号形式;文字将知识从脆弱的生物记忆移入持久的物质记录;印刷术实现了社会规模下的知识机械化复制;数字计算则将算术与符号处理从神经劳动转移至可编程机器。在这些转型中,关键变化并非人类在失去人工制品后变得能力平庸,而是人工制品重构了认知系统——通过将选定的负担向外转移,释放有限的内部资源用于规划、抽象和创造 [Norman, 1993]。这种向外委派(Outward Delegation)的模式,如今正重现在机器智能的前沿领域,即大语言模型(LLM)智能体的设计中。

这一视角在“认知人工制品”理论 [Norman, 1991, 1993] 中拥有天然的理论锚点。其核心洞察在于:外部辅助工具并非仅仅放大原有的内部能力,它们往往会改变任务本身。购物清单并未扩展生物记忆容量,而是将困难的“回忆(Recall)”问题转化为了“识别(Recognition)”问题。地图并非单纯使导航变得更“强”,而是将隐藏的空间关系转化为了可见的结构。因此,人工制品的威力在于表征转型(Representational Transformation):它重构了问题,使智能体能够利用既有能力更可靠地解决问题 [Norman, 1991]。

我们认为,同样的逻辑正主导着 LLM 智能体中最具影响力的设计选择。本文的核心论点是:外部化——即认知负担从模型的内部计算向持久、可检查且可复用的外部结构持续迁移——是解释近期内存、技能、协议及框架工程(Harness Engineering)进展的转型逻辑(Transition Logic)。这不仅是关于工程便利性的主张,更是关于“可靠代理性(Reliable Agency)”来源的主张:它并非仅源于不断扩大的模型,而是源于任务需求的系统性重构,使内部能力与外部基础设施共同覆盖所需的全部能力项 [Norman, 1991, Sumers et al., 2024]。

图 1 总结了上述论点。上层面板追溯了人类认知外部化的轨迹;中层面板展示了 LLM 智能体对应的演进路径,从权重出发,经过内存、技能、协议三个外部化维度,最终汇聚于支撑框架(Harness);下层面板则将现有文献景观映射为三个能力层:权重层、上下文层和框架层。图 3 补充了外部化智能体的架构概览,显示框架位于中心,三个外部化维度及其操作元素环绕运行。内存实现了跨时间的决策状态外部化,技能实现了程序化专业知识的外部化,协议实现了交互结构的外部化。这两条演进曲线的平行关系编码了一个递归命题:LLM 智能体本身即是运行在人类最新重大外部化产物——数字计算——之上的认知人工制品。其共同机制是 Norman 意义上的表征转型 [Norman, 1991]:回忆转变为识别,即兴生成转变为模块组合,而临时协作转变为结构化契约。

这一视角对于理解当前的工程实践尤为清晰。当代进展常被描述为更大模型、更优训练程序或更复杂推理链的竞赛。这些因素固然重要,但不足以完全解释实际系统中的观察模式。许多可靠性的巨大提升并非源于基础模型的改变,而是源于模型周围环境的改变:增加持久内存、组织可复用技能、标准化工具接口、约束执行逻辑、监测行为并经由显式控制逻辑路由任务 [Sumers et al., 2024, Wang et al., 2024a, Li, 2025, Luo et al., 2025]。在实践中,核心问题日益演变为:“哪些负担已被外部化,从而使模型不再需要每次都进行内部求解?”

未经辅助的 LLM 仍面临三个经常性的错位,这些错位直接对应框架的三个维度。其一,上下文窗口有限且会话记忆缺失,导致了由内存外部化解决的连续性问题。其二,长程多步程序往往被重复推导而非一致执行,导致了由技能外部化解决的方差问题。其三,若仅依赖自由格式的提示词,与外部工具、服务及协作者的交互将极具脆性,导致了由协议外部化解决的协同问题 [Sumers et al., 2024, Packer et al., 2023]。外部化的意义在于,它将每一种负担转化为模型能更可靠处理的形式。

一个具体的例子有助于建立直观理解:考虑一个被要求在大型仓库中实现功能、运行测试并提交 PR(拉取请求)的软件工程智能体。若无外部化,模型必须在脆弱的提示词(Prompt)中维持仓库结构、项目规范、工作流状态和工具交互;若具备外部化,持久的项目内存提供上下文,可复用的技能文档编码规范与工作流,协议化的工具接口强制执行正确的 Schema,而支撑框架负责序列化步骤、验证输出并管理失败。基础模型可能保持不变,改变的是它被要求解决的任务表征。

这种更广泛的视角也符合分布式认知与扩展认知(Distributed and Extended Cognition)的直觉:一旦记忆、行动引导和交互协调的关键部分被委派给外部结构,智能便不再局限于模型内部 [Clark and Chalmers, 1998]。我们借鉴这一传统,旨在获取其核心工程洞察——即“智能体”与“环境”的边界是一种具有实际性能影响的设计选择——而非致力于其强本体论主张。我们的焦点是务实的:我们将外部化视为一种设计原则,其价值通过所得系统的可靠性、组合性和可治理性来衡量。