视觉 - 语言 - 动作(VLA)模型一直被视为通用机器人的核心突破口,可强悍性能的背后,始终绕不开普通硬件带不动、算力成本过高的难题。如今,中山大学、MBZUAI 、Spatialtemporal AI 与 ATeam团队联合推出A₁模型,不靠堆参数、不依赖闭源数据,凭借一套自适应推理机制,在保持顶尖操控性能的同时,大幅压低推理成本,让高效能机器人 AI 第一次真正具备了规模化落地的可能。 当机器人能够听懂自然语言、理解复杂场景并完成灵活的精细操作,具身智能才算真正走进现实。而支撑这一切的核心技术,正是视觉 - 语言 - 动作(VLA)模型。它将视觉感知、语言指令与机械臂运动控制融为一体,让机器人拥有了类似人类的常识判断与操作能力。可一路飙升的模型性能,也带来了一个极为现实的问题:越强大的 VLA 模型,落地成本越高。 当下主流的 VLA 模型,往往依赖数十亿参数的视觉语言骨干网络,再搭配需要十数次迭代去噪的生成式动作头,算力消耗巨大、推理延迟明显。即便现有研究对骨干网络做了量化、剪枝等优化,也始终没能解决动作头的效率瓶颈,高性能与低成本,似乎成了 VLA 模型无法兼顾的两端。

01

核心设计:让模型 “聪明省算力”,不做无用功

A₁模型从根源上跳出了 “减性能或加算力” 的固有思路,研究团队通过大量实验总结出关键规律:机器人动作轨迹只需极少步去噪即可锁定正确模式,连续动作变化平滑且冗余度高,VLM 中间层特征已足够支撑可靠动作生成。 基于此,A₁确立了自适应算力分配的核心逻辑 —— 只在动作发生有效变化时计算,动作稳定就提前终止,从根本上杜绝算力浪费。这也是它能在性能不打折的前提下,实现极致高效推理的关键。

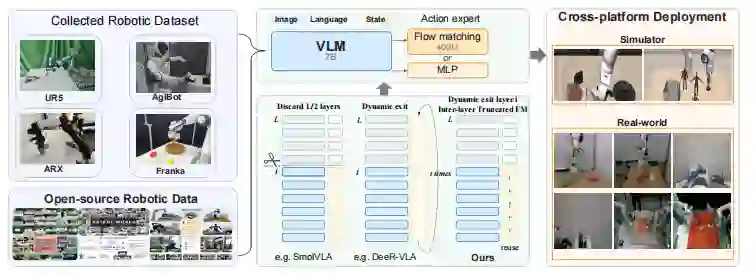

图1:A1 模型整体架构

02

技术突破:双核心创新,同时加速骨干与动作头

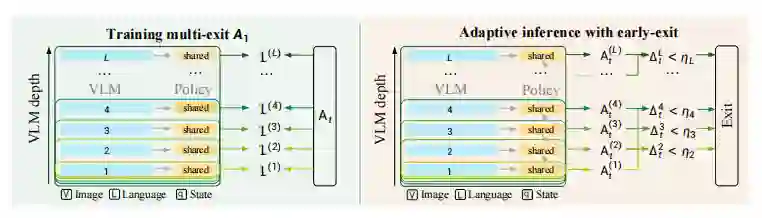

A₁最核心的价值,是同时解决了 VLM 骨干笨重、动作头迭代缓慢两大行业难题,实现真正的端到端加速。 模型采用动作一致性早退出机制,训练时让 VLM 每一层都连接动作头,推理时逐层对比动作差异,达到阈值立即停止计算,简单任务浅层即可完成,复杂任务再深入深层。针对早退出可能导致动作头变瓶颈的问题,团队创新提出层间截断流匹配,将去噪步数大幅压缩,并且让下一层动作生成直接承接上一层结果热启动,无需从噪声重新初始化,像接力一样连贯生成动作,彻底消除冗余计算。

图2:训练与自适应推理流程

这两项技术结合,让 A₁摆脱了 “拆东墙补西墙” 的妥协优化,实现骨干网络与动作头的协同加速。

03

全场景验证:仿真→真机→竞赛,全面领先

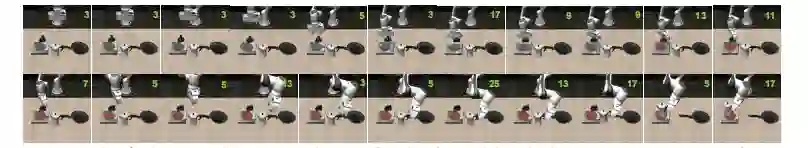

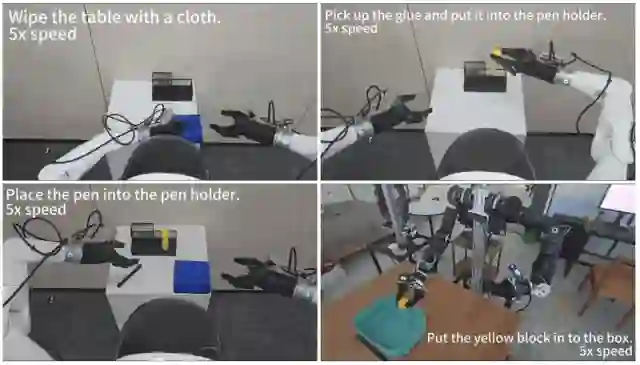

A₁的性能并非实验室跑分,而是在仿真、真实机械臂、权威竞赛三大场景完成严格验证。 在仿真基准中,模型操作成功率逼近满分,物体定位与长时序任务表现稳定;迁移到 Franka、AgiBot、OpenArm 等多款真实机械臂上,面对水果装盘、桌面清洁、物品归位等易干扰任务,A₁的抓取精度与动作稳定性显著优于主流开源模型,小样本学习场景下也能快速适配。在 RoboChallenge 真实机器人竞赛基准中,A₁以完全开源的姿态,超越多个知名模型,在开抽屉、放杯垫、叠碗等精细操作上近乎完美。

图3:长时序任务执行对比图

图4:A₁在双臂机器人平台OpenArm 部署演示

图5:自适应推理可视化

图6、7:现实世界任务示例

更重要的是,A₁实现了降本不降质,计算量与推理时间大幅下降,操作成功率几乎无损失,普通硬件即可支撑实时控制,彻底打破高算力依赖。

04

全栈开源:透明可复现,重新定义 VLA 研究范式

与大量闭源、半开源的机器人大模型不同,A₁坚持彻底开放的理念,团队承诺全栈开放所有技术内容,包括模型权重、训练与推理代码、数据处理管道、评估脚本等,实现完全可复现、可审计、可二次开发。 这一做法打破了闭源数据与训练流程的壁垒,为机器人 VLA 社区提供了公平、透明、高效的研究基线,也让产业界可以低成本二次开发,快速落地到真实场景。 未来,团队将进一步融合无监督学习与强化学习,优化云端延迟问题,拓展双臂移动机器人场景,让 A₁的动作更流畅、泛化性更强。 结语

从盲目堆参数到智能用算力,从闭源垄断到全栈开放,A₁模型重新定义了高效能 VLA 的发展方向。它证明了顶尖的机器人视觉 - 语言 - 动作模型,不必以高算力、高成本为代价,真正实现性能、效率与开放性的兼顾。 在具身智能快步走向现实的今天,A₁不仅是一款优异的机器人大模型,更是一条可复制、可量产的落地路径,为通用机器人走进千家万户打下坚实基础。

论文信息:

**论文题目:**A₁: A Fully Transparent Open-Source, Adaptive and Efficient Truncated Vision-Language-Action Model **论文链接:**https://arxiv.org/abs/2604.05672 **代码链接:**https://github.com/ATeam-Research/A1 **项目页:**http://www.ateam.xin/#/research/A1