人工智能赋能技术快速进步并融入目标打击行动,已引发围绕其伦理、法律及作战影响的持续辩论。过去十年间,关于人工智能在战争中的讨论主要集中在自主武器系统上,这部分由2013年开始的相关讨论及在联合国《特定常规武器公约》框架下设立的“致命性自主武器系统政府专家组”所推动的规范化进程所驱动,该进程完全聚焦于自主武器系统。然而,人工智能决策支持系统日益融入目标打击实践,引入了新的复杂性,需要此辩论中更广泛的利益攸关方予以更多关注。人工智能决策支持系统是指“利用人工智能技术收集和分析数据、提供关于作战环境的信息以及可操作建议,旨在协助军事决策者评估与法律合规性相关因素的工具,例如采取预防措施和确保攻击的比例性”。与无需人工干预直接选择和攻击目标的自主武器系统不同,人工智能决策支持系统在军事行动的信息和分析维度内运作,这导致一种假设,即它们仅用于增强而非取代人类决策。它们被描述为在不对使用武力产生直接影响的前提下,增强人类决策过程。这种描述引发了一种说法,即鉴于指挥官、操作员及更广泛用户的决策最终会经过多层次的人工监督来审查,整合人工智能决策支持系统几乎不构成挑战。这些层级包括使用额外情报源进行目标核实与验证的过程。因此,这些系统中的错误或不准确之处常被认为非关键性的,因为假定其可通过强有力的人工监督得以缓解。

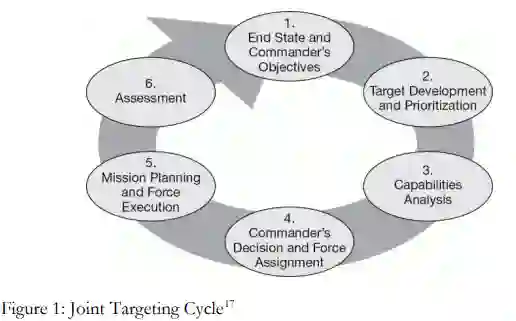

然而,近期冲突已显示出人工智能决策支持系统被用于目标选择甚至提名等关键职能的确凿证据,这可能制约、限制甚至将人类排除在联合目标打击周期的这些核心步骤之外。这引发了关于此类系统对决策过程的影响以及用户遵守国际人道法义务能力的重大法律关切,特别是在采取一切可行预防措施以保护平民和平民物体免受攻击影响,并确保遵守区分原则和比例原则的义务方面。

由于人工智能决策支持系统被框定为仅仅是工具,其使用如何影响联合目标打击周期内认知决策过程的问题一直被分析不足且被低估。此外,对自主武器系统的持续关注以牺牲对人工智能决策支持系统的关注为代价,模糊了在塑造作战和战略结果方面对人工智能日益增长的依赖。辩论中的这一空白也归因于围绕特定人工智能决策支持系统如何运作存在有问题的透明度缺失,以及一贯缺乏甚至粗略审视其实际使用方式的能力。尽管关于自主武器系统的政策和法律讨论中的某些经验教训可以且应当有意义的推及到人工智能决策支持系统的背景中,但这些综合因素导致了对人工智能决策支持系统可能如何影响或在联合目标打击周期内运作的分析不足。

本文旨在弥补这些空白,并挑战当前对人工智能决策支持系统的主流框架设定、其看似无问题的性质以及关于人类用户在与这些系统互动中所扮演角色的假设。虽然人工智能决策支持系统在本质上具有多样性,即其设计和所提供的建议类型存在显著差异,但作为案例研究,考察了据称以色列国防军对其的使用,主要聚焦于自2023年10月7日哈马斯袭击以色列以来的使用情况。首先必须申明,此举并非旨在最终证实此案例研究中各要素的真实性,而是为了展示某些人工智能决策支持系统使用的具体作战现实,这些现实在一定程度上可被推广,因为它们也反映了其他人工智能决策支持系统集成时出现的更广泛的人机协同问题。本文面向关注当今开发、集成和部署此类技术用于作战的军方、行业代表和政策制定者。同样呼吁研究人员进一步在这一研究不足的领域进行跨学科和跨领域的合作与交流。希望这能作为一个号召,不仅全面分析人工智能决策支持系统带来的任何益处,更重要的是分析其可能引入的风险。

在全文,探讨了人工智能决策支持系统在联合目标打击周期内的法律影响。特别旨在强调,在联合目标打击周期中使用人工智能决策支持系统时,遵守攻击中预防措施原则下的法律义务的重要性及相关挑战。通过以下方式展开论述:首先,对联合目标打击周期进行描述性概述,以展示国际人道法原则在何处及如何被操作化。接着,概述了据称以色列国防军使用人工智能决策支持系统的情况作为案例研究。然后,对据称以色列国防军使用人工智能决策支持系统的情况进行法律分析,并根据联合目标打击周期内的法律义务,审视这些系统的集成和使用所产生的影响,以突显其中的矛盾与关切。在全文,审视了与人机协同相关的更广泛关切,包括决策速度和规模提升的影响。此外,论及偏见的影响、这些偏见如何影响联合目标打击周期内的人类认知决策,以及人工智能决策支持系统的使用结合此类系统引入的准确性和错误率问题,会引发何种法律影响。最后,以关于在联合目标打击周期内使用人工智能决策支持系统的建议作为结语,呼吁通过聚焦人工智能决策支持系统在联合目标打击周期中被忽视但关键的作用,以及围绕其使用的更广泛辩论和潜在监管框架的转变,来重新评估其应用。