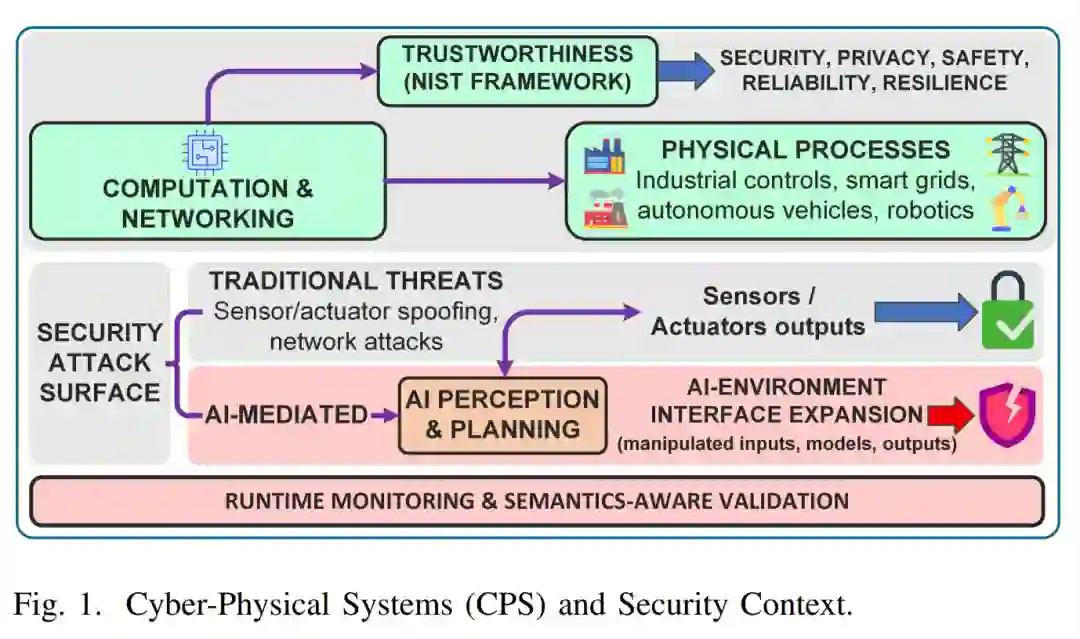

AI 智能体与网络物理系统(CPS)日益紧密的集成引入了全新的安全风险,这些风险已超出了传统的网络或物理威胁模型的范畴。生成式人工智能(Generative AI)的最新进展使得深度伪造(Deepfake)与语义操控攻击成为可能,此类攻击能够破坏智能体的感知、推理及其与物理环境的交互;与此同时,**模型上下文协议(MCP)等新兴协议通过动态工具调用和跨域上下文共享,进一步扩大了系统的攻击面。 本综述全面回顾了针对 CPS 中 AI 智能体的安全威胁,重点关注环境交互、深度伪造驱动的攻击以及由 MCP 介导的脆弱性。我们利用 SENTINEL 框架对现有文献进行了系统梳理——这是一种具备生命周期感知(lifecycle-aware)能力的方法论,集成了威胁特征刻画、CPS 约束下的可行性分析、防御策略选择以及持续验证。通过一个基于真实智能电网部署的全流程案例研究,我们定量地阐释了时间延迟、噪声以及误报成本如何限制防御措施的部署,并揭示了为何在安全关键型(safety-critical)的 CPS 中,仅凭检测机制不足以作为决策权威。本综述强调了基于来源溯源(provenance-grounded)与基于物理规律(physics-grounded)**的信任机制及纵深防御架构的重要性,并指出了构建可信 AI 驱动型 CPS 所面临的开放性挑战。 索引词网络物理系统 (CPS)、AI 智能体、模型上下文协议 (MCP)、深度伪造攻击、人工智能生成内容 (AIGC)、安全性、检测、防御、缓解。

一、 引言 (INTRODUCTION)

随着自主 AI 智能体(AI Agents)日益集成到网络物理系统(CPS)中,智能决策与物理世界之间的界限正变得模糊。这些智能体赋予了系统感知能力、决策逻辑以及执行机构的影响力,有望在智能电网、自动驾驶汽车、工业自动化及机器人等领域显著提升效率、适应性和自主性 [352]。然而,当 AI 与环境的交互界面成为关键的通信渠道时,全新的安全与隐私漏洞随之产生,特别是当攻击者利用合成内容(如深度伪造 Deepfakes)来欺骗机器和人类时 [55], [175]。 虽然传统的 CPS 安全研究集中于传感器欺骗、拒绝服务(DoS)攻击和内部威胁 [352],但强大的生成式模型的出现引出了一类新型威胁:人工智能生成内容(AIGC),包括图像、视频、音频、文本及行为仿真。此类内容可以伪装成合法的环境数据或人类指令,从而颠覆系统运行或误导人类操作人员。例如,深度伪造视频流可能欺骗监控摄像头,克隆声音可以冒充授权操作员,而伪造的传感器轨迹则可能掩盖真实的物理异常 [55], [145]。深度伪造令人信服的模拟能力加剧了挑战:防御者不能仅依赖人类判断或经典的异常检测器 [175]。 与此同时,AI 智能体必须在交互界面应对不可预测性:它们摄取外部数据(传感器流、图像、语音)并在物理世界产生行动。因此,智能体-环境(A–E)交互面成为了对抗性操纵的丰富目标。攻击者可以通过注入精心设计的输入或操纵环境信号来迫使系统发生错误行为、引发不安全动作或隐藏攻击 [82]。 一个核心挑战是缺乏一套系统的框架,将大量的安全研究成果转化为针对特定 CPS 场景的可部署解决方案。虽然文献提供了众多的检测技术、缓解策略和威胁分析,但由于部署环境的独特约束,系统设计者缺乏选择和组合这些机制的结构化指导。CPS 的运行条件与传统信息技术系统有着本质区别: * 实时性要求:性能要求通常以毫秒计。 * 资源受限:计算资源受限于边缘设备的性能。 * 安全关键型(Safety-critical)需求:运营需求要求安全机制不得干扰物理过程控制。

此外,现代智能体协议(如 模型上下文协议 MCP)的分布式架构引入了传统安全框架无法充分解决的信任边界和交互面问题。 为了弥补这一空白,本综述引入了 SENTINEL(系统化评估与威胁告知型网络防御选择)框架。它提供了一套六阶段方法论,引导系统设计者从最初的威胁评估,经过防御机制选择、纵深防御架构设计、验证规划,直至持续适应。该框架通过结合威胁建模、资源约束分析和操作要求,使从业者能够系统地将安全机制与其特定的部署环境相匹配。 本综述聚焦于两个交汇轴心:CPS 中 AI-环境交互面由 AIGC 引起的安全与隐私威胁。我们的目标是提供关于深度伪造和合成内容威胁如何在 CPS 中体现,以及检测和缓解技术如何演进以应对这些挑战的严谨、全面的视角。本文提出的核心论点是:以检测为中心的安全性对于 AI 驱动型 CPS 是根本不足的;相反,可信运行需要**具备生命周期感知、基于来源溯源及物理规律约束(provenance- and physics-grounded)**的系统设计,并将 AI 智能体和 MCP 视为 CPS 控制架构中不可或缺的组件。

**本文的主要贡献总结如下:

SENTINEL 系统框架:提供了一种结构化方法论,用于选择和组合量身定制的 CPS 安全机制。 1. 深度伪造模态分类学:针对 CPS 领域的视觉、音频、文本、行为伪造进行分类,并提供其破坏智能体或系统功能的具体案例。 1. 系统性技术综述:回顾了 CPS 相关场景下的深度伪造检测技术,对比了其在受限环境下的实时性、优缺点及适用性。 1. 防御策略概览:涵盖了从来源溯源/认证、水印技术、多模态融合到鲁棒训练及策略级措施的缓解方案。 1. 端到端案例研究:利用 ANCHOR-Grid 展示了 SENTINEL 框架如何在具体的定时、噪声和安全约束下运行。 1. 开放挑战与方向讨论:强调了实时性能、泛化能力、隐私保护与适应性攻击者之间的权衡关系。

通过整合 AI 安全、生成式模型和 CPS 弹性方面的最新文献见解,我们希望本综述能为寻求在 CPS 中构建可信 AI 智能体的研究人员和系统设计者提供基础性的参考。