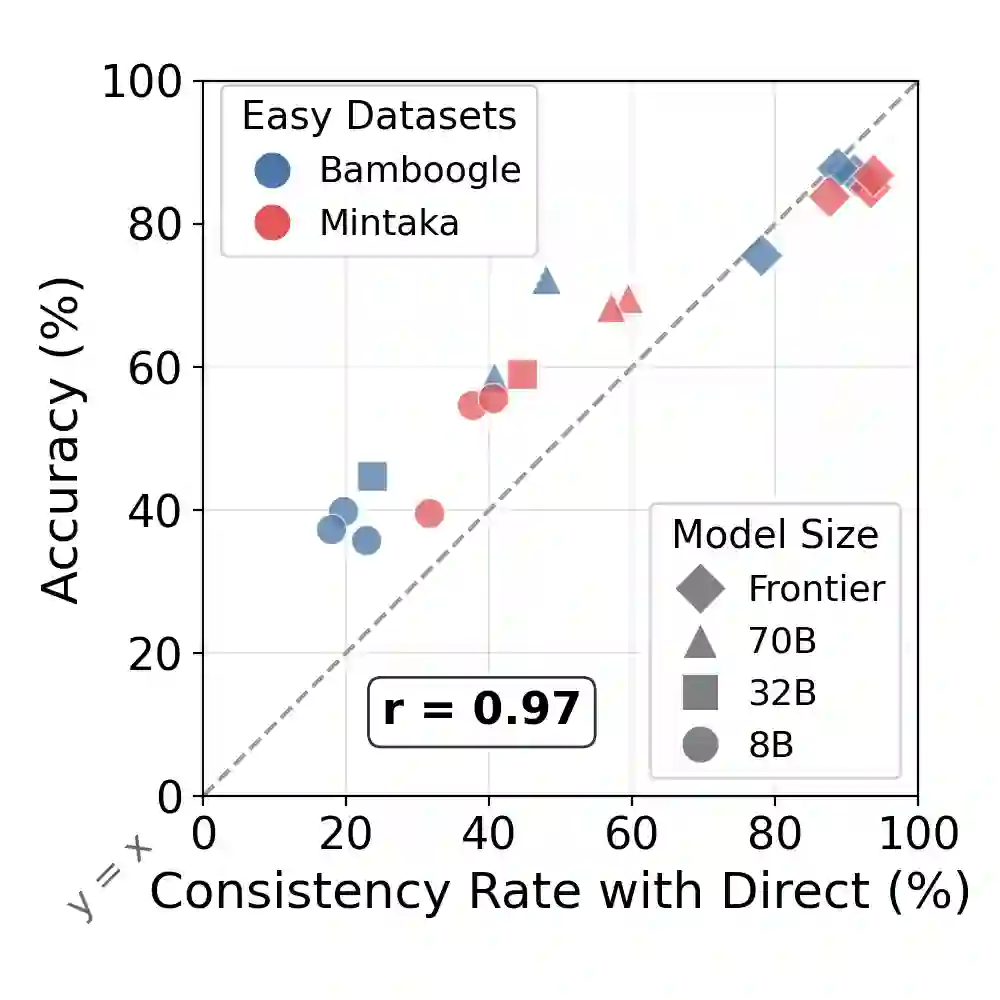

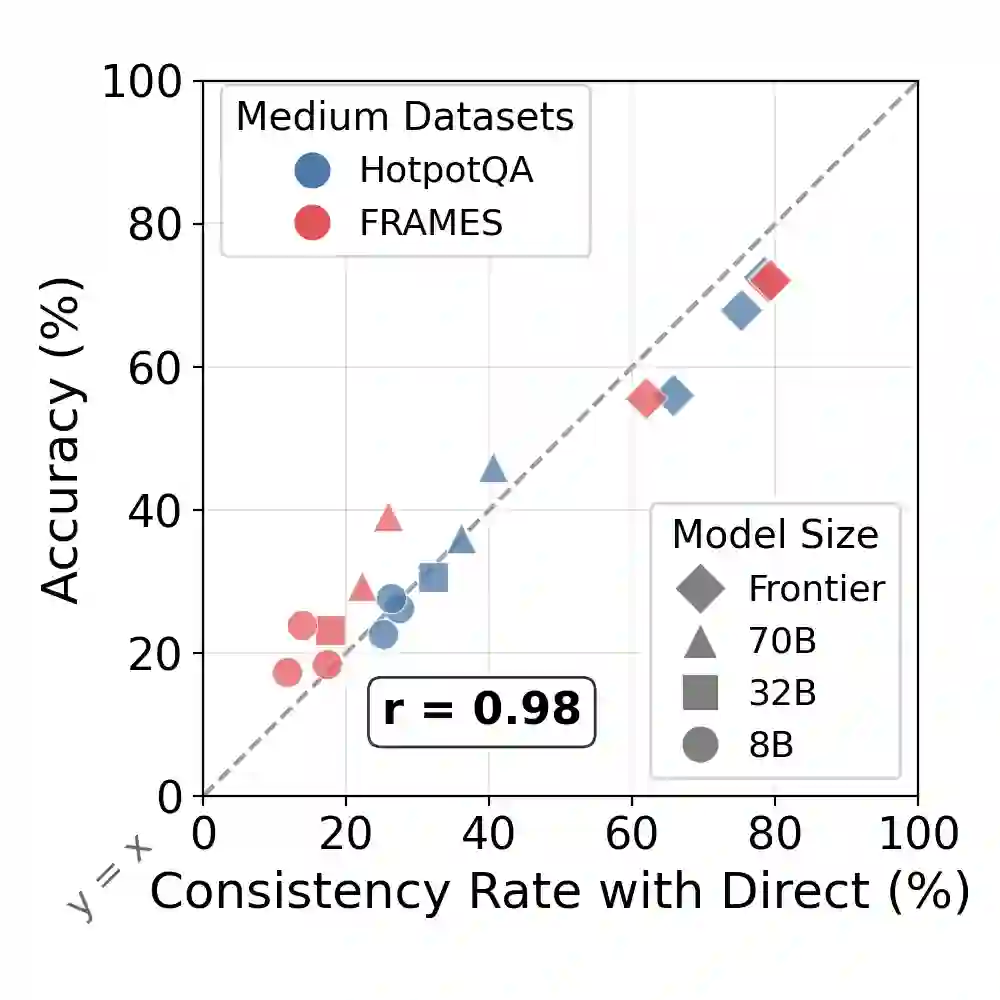

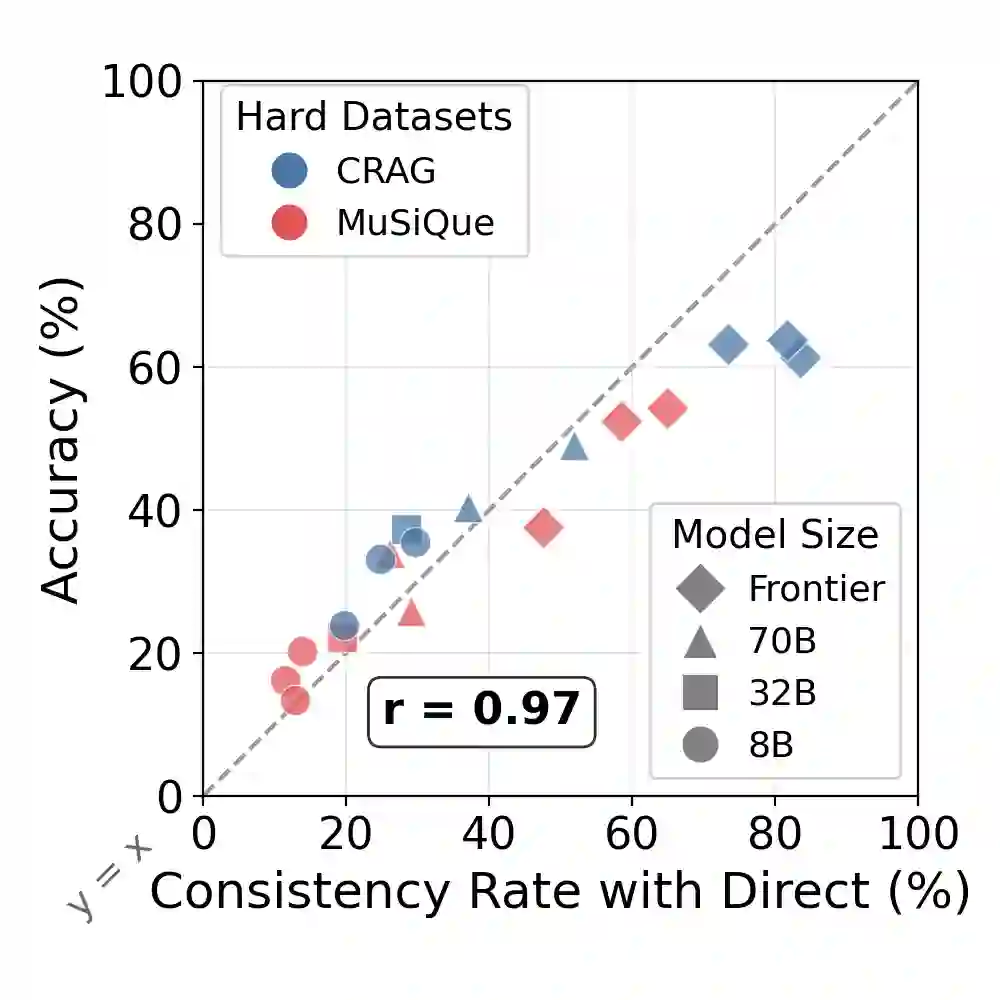

Large language models often struggle to recognize their knowledge limits in closed-book question answering, leading to confident hallucinations. While decomposed prompting is typically used to improve accuracy, we investigate its impact on reliability. We evaluate three task-equivalent prompting regimes: Direct, Assistive, and Incremental, across different model scales and multi-hop QA benchmarks. We find that although accuracy gains from decomposition diminish in frontier models, disagreements between prompting regimes remain highly indicative of potential errors. Because factual knowledge is stable while hallucinations are stochastic, cross-regime agreement provides a precise signal of internal uncertainty. We leverage this signal to implement a training-free abstention policy that requires no retrieval or fine-tuning. Our results show that disagreement-based abstention outperforms standard uncertainty baselines as an error detector, improving both F1 and AUROC across settings. This demonstrates that decomposition-based prompting can serve as a practical diagnostic probe for model reliability in closed-book QA.

翻译:大型语言模型在闭卷问答中往往难以识别自身知识边界,导致产生自信的幻觉性回答。尽管分解式提示通常用于提升准确性,本研究重点探究其对可靠性的影响。我们在不同规模模型与多跳问答基准上评估了三种任务等效的提示范式:直接式、辅助式与渐进式。研究发现,虽然前沿模型中分解带来的准确率增益有所减弱,但不同提示范式间的分歧仍能有效指示潜在错误。由于事实性知识具有稳定性而幻觉具有随机性,跨范式一致性可为模型内部不确定性提供精确信号。我们利用该信号实现了无需检索或微调的免训练弃答策略。实验结果表明,基于分歧的弃答机制作为错误检测器优于标准不确定性基线,在多种设定下同步提升了F1分数与AUROC指标。这证明基于分解的提示方法可作为闭卷问答中模型可靠性的实用诊断探针。