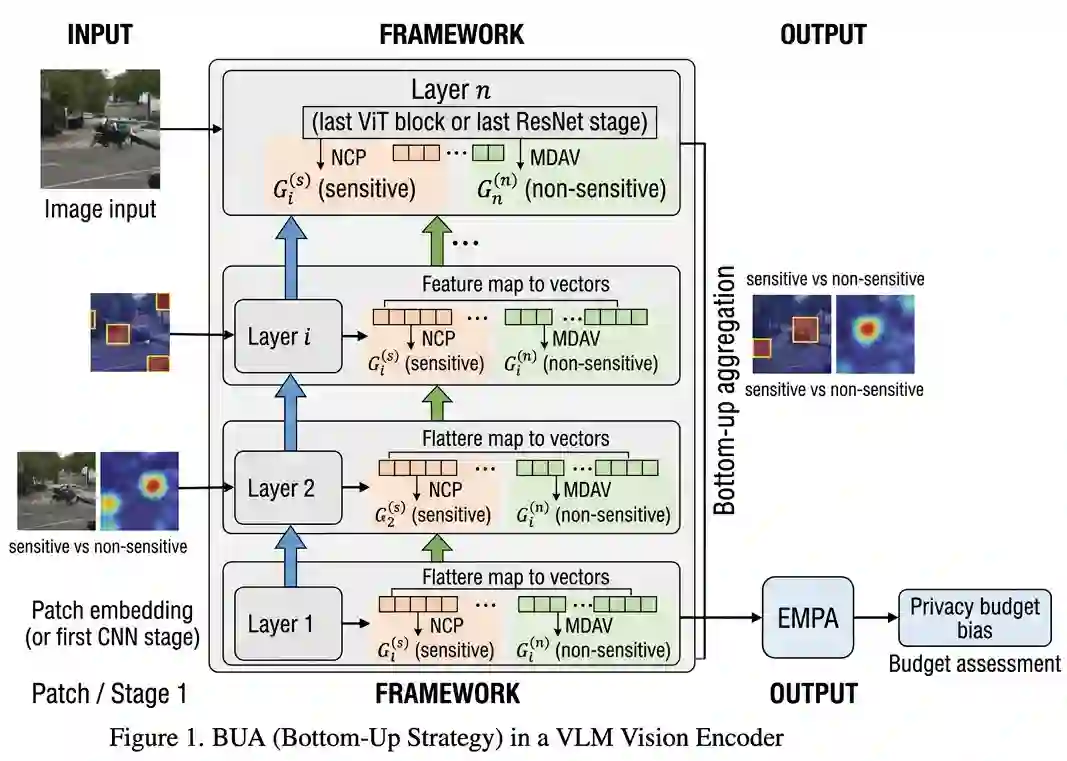

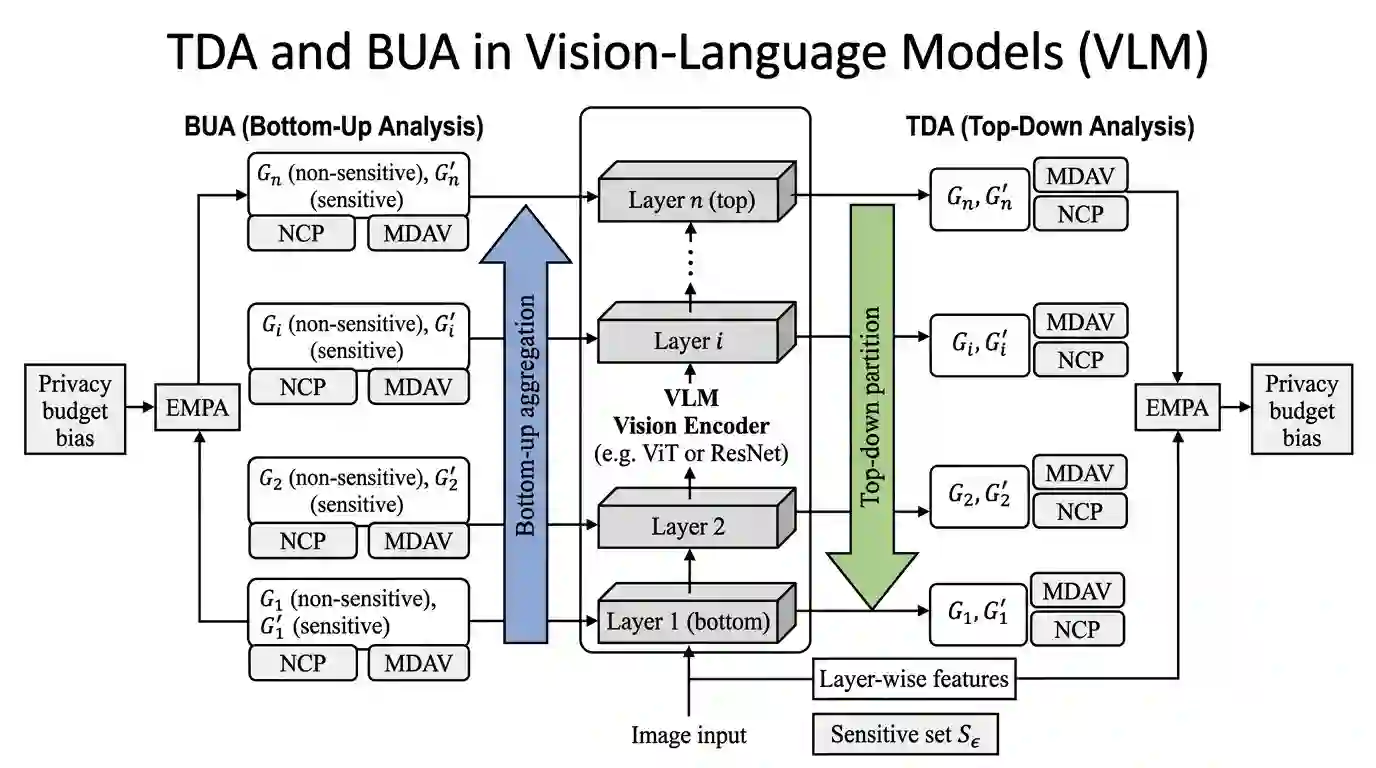

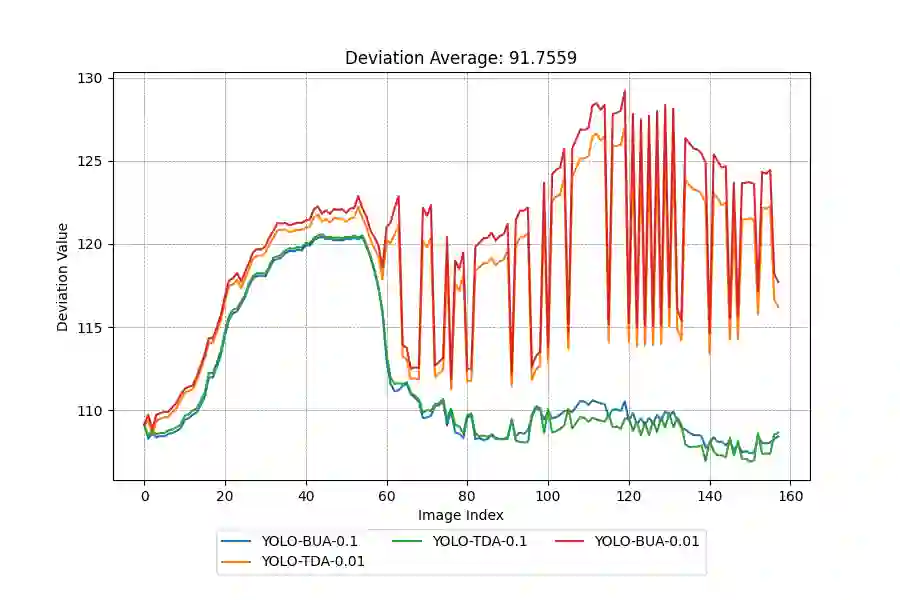

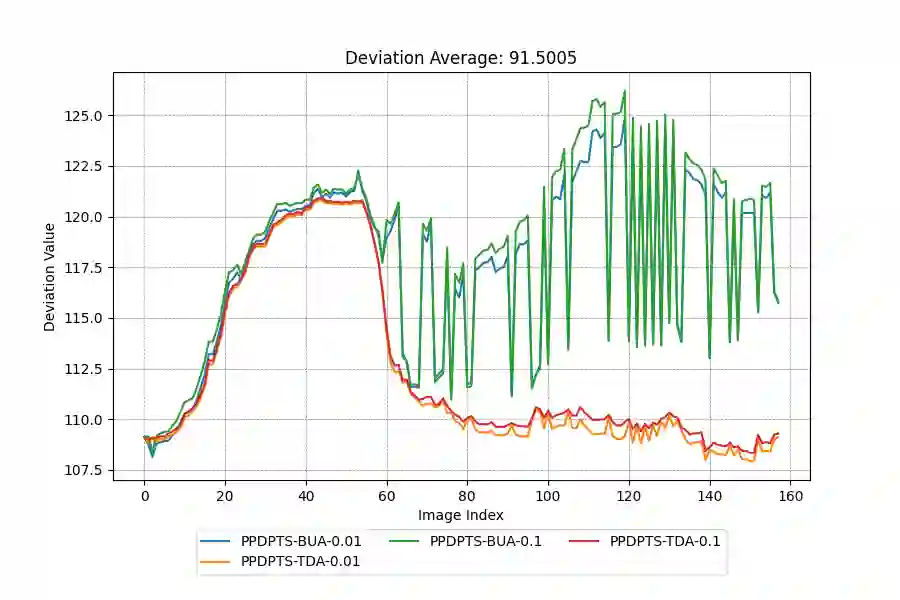

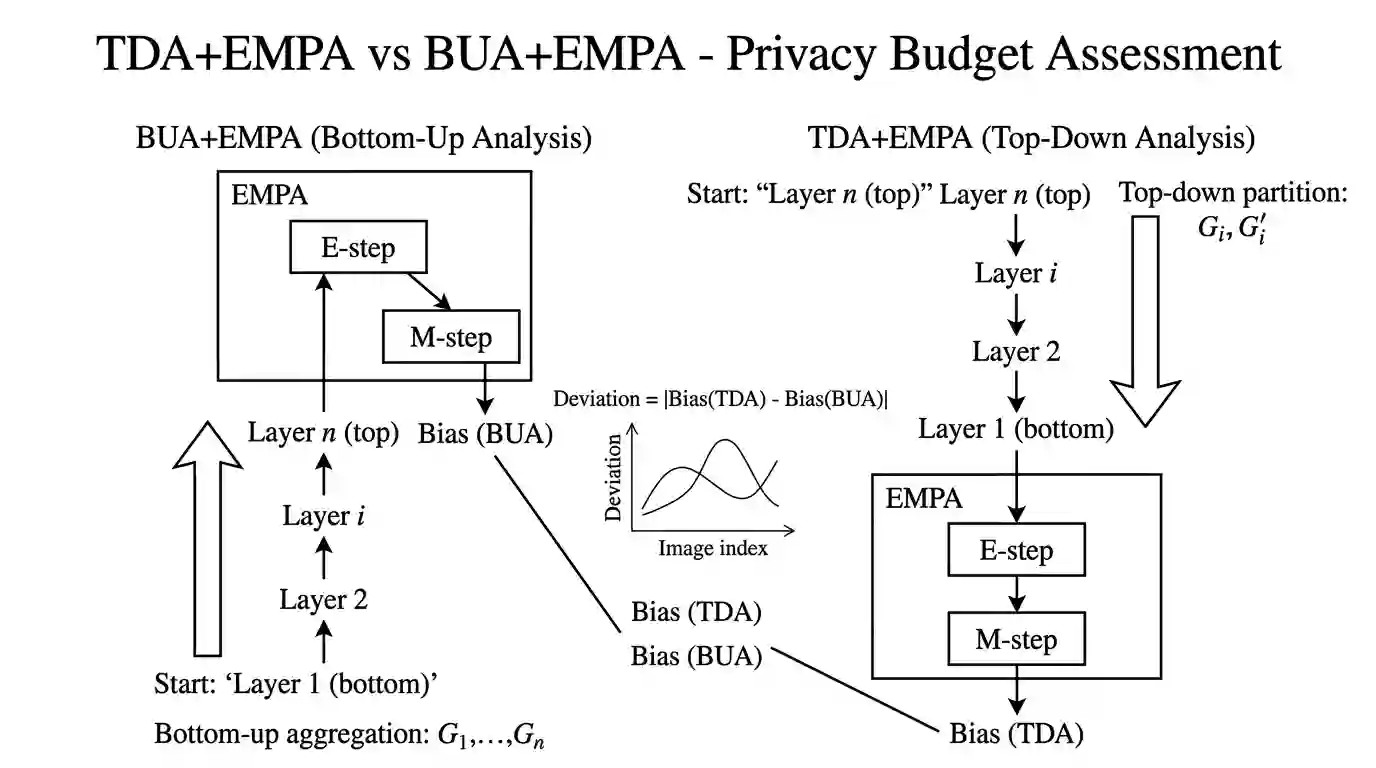

Learning systems that preserve privacy often inject noise into hierarchical visual representations; a central challenge is to \emph{model} how such perturbations align with a declared privacy budget in a way that is interpretable and applicable across vision backbones and vision--language models (VLMs). We propose \emph{Bodhi VLM}, a \emph{privacy-alignment modeling} framework for \emph{hierarchical neural representations}: it (1) links sensitive concepts to layer-wise grouping via NCP and MDAV-based clustering; (2) locates sensitive feature regions using bottom-up (BUA) and top-down (TDA) strategies over multi-scale representations (e.g., feature pyramids or vision-encoder layers); and (3) uses an Expectation-Maximization Privacy Assessment (EMPA) module to produce an interpretable \emph{budget-alignment signal} by comparing the fitted sensitive-feature distribution to an evaluator-specified reference (e.g., Laplace or Gaussian with scale $c/ε$). The output is reference-relative and is \emph{not} a formal differential-privacy estimator. We formalize BUA/TDA over hierarchical feature structures and validate the framework on object detectors (YOLO, PPDPTS, DETR) and on the \emph{visual encoders} of VLMs (CLIP, LLaVA, BLIP). BUA and TDA yield comparable deviation trends; EMPA provides a stable alignment signal under the reported setups. We compare with generic discrepancy baselines (Chi-square, K-L, MMD) and with task-relevant baselines (MomentReg, NoiseMLE, Wass-1). Results are reported as mean$\pm$std over multiple seeds with confidence intervals in the supplementary materials. This work contributes a learnable, interpretable modeling perspective for privacy-aligned hierarchical representations rather than a post hoc audit only. Source code: \href{https://github.com/mabo1215/bodhi-vlm.git}{Bodhi-VLM GitHub repository}

翻译:保护隐私的学习系统通常向层次化视觉表征中注入噪声;一个核心挑战在于如何以可解释且适用于不同视觉骨干网络和视觉-语言模型(VLM)的方式,对这种扰动与声明的隐私预算之间的对齐关系进行建模。我们提出Bodhi VLM,一个针对层次化神经表征的隐私对齐建模框架:它(1)通过基于NCP和MDAV的聚类,将敏感概念与逐层分组相关联;(2)利用自底向上(BUA)和自顶向下(TDA)策略在多尺度表征(例如特征金字塔或视觉编码器层)上定位敏感特征区域;(3)使用期望最大化隐私评估(EMPA)模块,通过将拟合的敏感特征分布与评估者指定的参考分布(例如尺度为$c/ε$的拉普拉斯或高斯分布)进行比较,生成一个可解释的预算对齐信号。该输出是相对于参考的,并非一个正式的差分隐私估计量。我们形式化了在层次化特征结构上的BUA/TDA方法,并在目标检测器(YOLO、PPDPTS、DETR)和VLM的视觉编码器(CLIP、LLaVA、BLIP)上验证了该框架。BUA和TDA产生了可比较的偏差趋势;EMPA在所述设置下提供了稳定的对齐信号。我们与通用差异基线(卡方、K-L、MMD)以及任务相关基线(MomentReg、NoiseMLE、Wass-1)进行了比较。结果以多次随机种子的均值±标准差形式报告,置信区间详见补充材料。本工作贡献了一个可学习的、可解释的隐私对齐层次化表征建模视角,而非仅提供事后审计。源代码:Bodhi-VLM GitHub 仓库