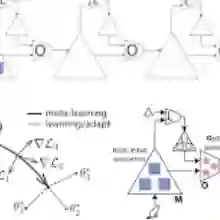

Recent advances in person re-identification (ReID) obtain impressive accuracy in the supervised and unsupervised learning settings. However, most of the existing methods need to train a new model for a new domain by accessing data. Due to public privacy, the new domain data are not always accessible, leading to a limited applicability of these methods. In this paper, we study the problem of multi-source domain generalization in ReID, which aims to learn a model that can perform well on unseen domains with only several labeled source domains. To address this problem, we propose the Memory-based Multi-Source Meta-Learning (M$^3$L) framework to train a generalizable model for unseen domains. Specifically, a meta-learning strategy is introduced to simulate the train-test process of domain generalization for learning more generalizable models. To overcome the unstable meta-optimization caused by the parametric classifier, we propose a memory-based identification loss that is non-parametric and harmonizes with meta-learning. We also present a meta batch normalization layer (MetaBN) to diversify meta-test features, further establishing the advantage of meta-learning. Experiments demonstrate that our M$^3$L can effectively enhance the generalization ability of the model for unseen domains and can outperform the state-of-the-art methods on four large-scale ReID datasets.

翻译:个人再识别(ReID)最近的进展在受监督和不受监督的学习环境中获得了令人印象深刻的准确性。然而,大多数现有方法都需要通过访问数据来培训一个新的领域的新模式。由于公共隐私,新的域数据并不总是可以获取,导致这些方法的可适用性有限。在本文件中,我们研究了ReID中多源域通用化问题,目的是学习一种在只有几个标签源域的无形域上能够很好地发挥作用的模式。为了解决这一问题,我们提议基于记忆的多源元学习(MetaBN)框架,以培训一个通用的隐蔽域模型。具体地说,采用元学习战略模拟域通用化的训练测试过程,以学习更通用的模型。为了克服参数分类造成的不稳定的元化,我们建议一种基于记忆的识别损失,该模型只能对几个标签源域进行校正和与元学习相协调。我们还提出一个基于元集的标准化结构(MetaberBN),以多样化元测试特征,进一步确立元化元化模型的优势。具体来说,采用元化学习模型的元化战略,以模拟域通用模型3 实验显示我们在大规模数据模型上可以改进四级的模型。