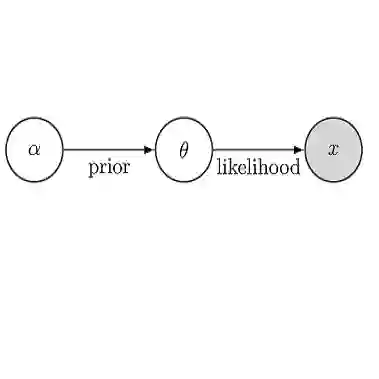

We develop a general framework for piecewise deterministic Markov process (PDMP) samplers that enables efficient Bayesian inference in non-linear inverse problems with expensive likelihoods. The key ingredient is a surrogate-assisted thinning scheme in which a surrogate model provides a proposal event rate and a robust correction mechanism enforces an upper bound on the true rate by dynamically adjusting an additive offset whenever violations are detected. This construction is agnostic to the choice of surrogate and PDMP, and we demonstrate it for the Zig-Zag sampler and the Bouncy particle sampler with constant, Laplace, and Gaussian process (GP) surrogates, including gradient-informed and adaptively refined GP variants. As a representative application, we consider Bayesian inference of a spatially varying Young's modulus in a one-dimensional linear elasticity problem. Across dimensions, PDMP samplers equipped with GP-based surrogates achieve substantially higher accuracy and effective sample size per forward model evaluation than Random Walk Metropolis algorithm and the No-U-Turn sampler. The Bouncy particle sampler exhibits the most favorable overall efficiency and scaling, illustrating the potential of the proposed PDMP framework beyond this particular setting.

翻译:我们开发了一个用于分段确定性马尔可夫过程(PDMP)采样器的通用框架,该框架能够在具有昂贵似然函数的非线性反问题中实现高效的贝叶斯推断。其核心是一种代理辅助细化方案,其中代理模型提供提议事件率,并通过动态调整加性偏移量(每当检测到违规时)来强制真实率的上界,从而形成一个稳健的校正机制。该构造与代理模型和PDMP的选择无关,我们以Zig-Zag采样器和Bouncy粒子采样器为例进行了演示,使用的代理模型包括常数、拉普拉斯和高斯过程(GP)代理,其中涵盖了梯度信息和自适应细化的GP变体。作为一个代表性应用,我们考虑了一维线性弹性问题中空间变化杨氏模量的贝叶斯推断。在不同维度下,与随机游走Metropolis算法和No-U-Turn采样器相比,配备基于GP代理的PDMP采样器在每次正演模型评估中实现了显著更高的精度和有效样本量。Bouncy粒子采样器展现出最优的整体效率和可扩展性,这说明了所提出的PDMP框架在此特定场景之外的潜力。