人工智能为军事模拟提供了重要机遇,但现有方法往往难以生成稳健且可推广的策略。本论文为大型零和博弈中的启发式策略开发提出了一种神经先知算法,该算法将策略空间响应先知与神经网络收益估计和深度受限的部分搜索步相结合。神经先知算法与深度受限神经搜索的区别在于:它为每一代次使用固定的训练预算,通过基于分数差异的玻尔兹曼加权分布来调控对手采样,并利用部分搜索步以低得多的成本生成回放数据。在一个小型Atlatl兵棋推演测试环境中进行的评估表明,与之前性能遥遥领先的深度受限神经搜索相比,神经先知算法以不到其12%的运行时间实现了性能持平;在相同代次数后,其基准分数超出深度受限神经搜索30%以上,而计算资源消耗仍不足后者的6%。这些结果表明,神经先知算法能以显著更低的训练成本生成更强的策略,为军事规划人员提供了一个用于人工智能驱动的对手开发的可扩展框架。

• 第一章介绍论文的问题陈述与研究范围,概述研究问题与论文结构,并阐述论文的益处。

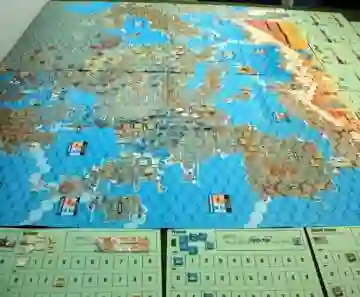

• 第二章提供研究背景与文献综述,涵盖作为研究使用的军事模拟框架的Atlatl、博弈论、强化学习以及当前用于军事模拟的人工智能工作。

• 第三章阐述为解答研究问题而进行实验所采用的研究方法与步骤。

• 第四章呈现实验的详细结果,提供数据与发现。

• 第五章分析并阐释结果,讨论其意义,回应研究问题,论述其对领域的贡献,并提出未来研究方向。

成为VIP会员查看完整内容