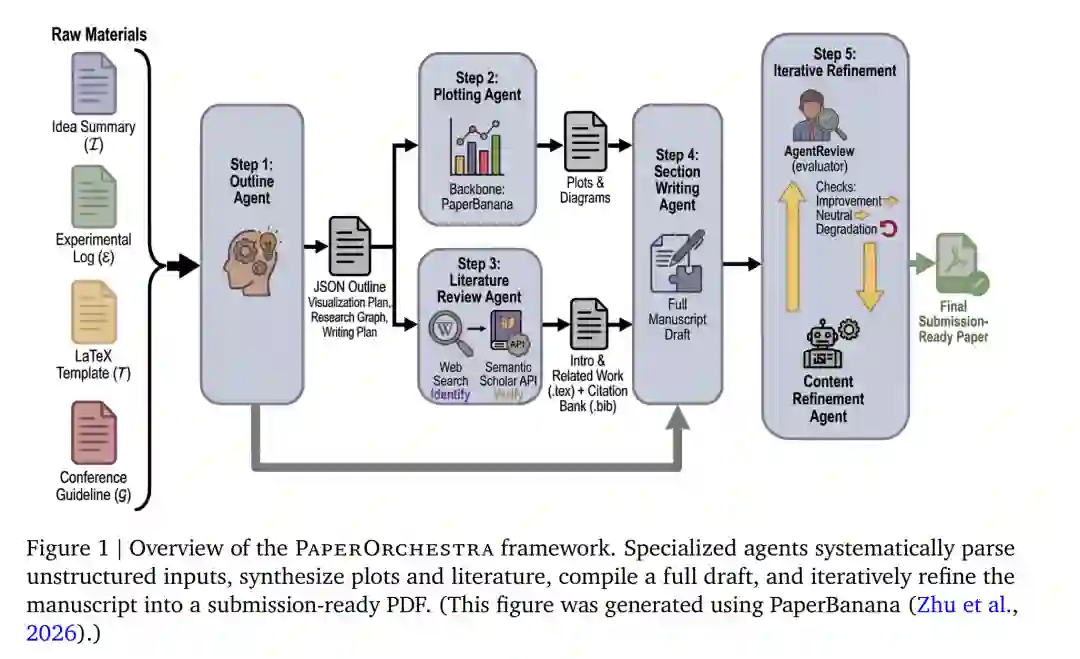

——将非结构化的研究资料合成(Synthesizing)为学术手稿,是人工智能驱动的科学发现(AI-driven scientific discovery)中一项至关重要却尚未得到充分探索的挑战。现有的自动化写作系统往往与特定的实验流水线强耦合,且生成的文献综述流于表面。为此,我们提出了 PaperOrchestra:一种用于自动化 AI 学术论文撰写的多智能体框架。该框架能够灵活地将不受限的撰写前材料(pre-writing materials)转化为达到投稿标准的 $\LaTeX$ 手稿,并包括全面的文献综合(literature synthesis)及生成的视觉内容(如实验图表和概念图)。为了评估系统性能,我们推出了 PaperWritingBench。这是首个标准化基准测试集,包含从 200 篇顶级 AI 会议论文中逆向提取的原始资料,并配套了一系列全自动评估工具。在双盲人工评估中,PaperOrchestra 的表现显著优于其他自动化基线模型,在文献综述质量上的绝对胜率领先 50%–68%,在手稿整体质量上领先 14%–38%。(项目主页:https://yiwen-song.github.io/paper_orchestra/)

1 引言

大语言模型(LLMs)的飞速发展正推动人工智能从辅助工具向科学发现的积极参与者转型 (Eger et al., 2025)。尽管近期出现的端到端自主框架 (Lu et al., 2024; Yamada et al., 2025) 证实了自动化研究闭环的可行性,但要实现其全部潜力,仍受阻于一个关键步骤:如何将非结构化材料(如原始创意和实验日志)转化为严谨且达到投稿标准的学术手稿。

早期自动化学术写作的尝试主要依赖于 LLM 的参数记忆,这往往导致事实性幻觉。为了缓解这一问题,近期的框架开始采用检索增强生成(RAG)方法。诸如 AutoSurvey2 (Wu et al., 2025) 和 LiRA (Go et al., 2025) 等系统,通过将文献综述过程分解为结构化阶段或模拟人类评审流程的专业智能体角色来实现。然而,这些专门针对综述开发的框架缺乏将原始实验数据转化为完整研究论文的能力。 另一方面,全生命周期自主研究智能体(full-lifecycle autonomous research agents)与其实验闭环紧密耦合,导致其无法作为独立的写作工具来处理人类提供的材料。实证评估显示,这些智能体在文献综合方面存在严重缺陷 (Beel et al., 2025; Tang et al., 2025b)。由于依赖简单的关键词搜索,这些智能体生成的综述往往流于表面且引用不足。此外,它们缺乏生成概念图的能力,使得视觉呈现仅限于代码生成的实验数据图表。再者,由于缺乏标准化的基准测试,独立评估自动化写作质量仍然困难重重。 为了填补这些空白,我们的核心贡献如下: * PaperOrchestra:一个独立的、多智能体协同框架,能够利用不受限的撰写前材料自主创作 $\LaTeX$ 手稿。该框架通过专业智能体进行深度的文献综合,生成实验图表与概念图,并迭代优化手稿以提升技术清晰度。 * PaperWritingBench:首个针对 AI 学术论文撰写的标准化基准测试集。该基准通过提供从 200 篇顶级 AI 会议论文中逆向提取的原始资料(包括创意和实验日志),实现了对写作任务的独立评测。 * 性能表现:在对照人工评估中,PaperOrchestra 的表现显著优于自主基线模型。在文献综述综合方面,其绝对胜率领先(即我方胜率与基线胜率之差)达 50%–68%;在手稿整体质量上,绝对胜率领先 14%–38%。