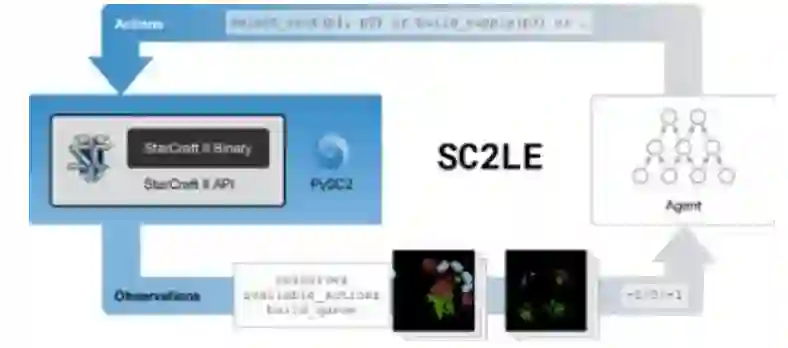

强化学习在即时战略游戏等复杂领域中取得了显著成功。然而,强化学习智能体不透明的决策过程,为人机协作和战略规划带来了挑战。本文提出了一个可解释强化学习框架,将可解释性技术与基于强化学习的决策在具有代表性的即时战略环境《星际争霸II》中相结合。这项工作引入了MIXTAPE(用于交互式可解释人工智能的中间件,具备基于树状结构的人工智能性能评估),这是一个旨在增强强化学习驱动的战略游戏透明度的系统。此外,开发了一个定制化强化学习基准,以弥合简易迷你游戏与完整游戏复杂性之间的差距,从而实现对人工智能决策策略的渐进式学习和评估。通过结合奖励分解、可视化模块和初步的用户研究设计,本研究为使强化学习智能体更具可解释性铺平了道路,最终旨在促进复杂现实场景中更优的人机协作。

为实现这些目标,本文做出了以下主要贡献:

• 定制化《星际争霸II》地图与渐进式基准测试:我们开发了专门的中等规模地图,将核心决策挑战——导航与战斗——分离开来,同时降低了相对于完整《星际争霸II》游戏的复杂度。这些地图作为系统化测试强化学习智能体及其解释的基准。

• 奖励分解与脚本:我们引入了部分脚本和分解的奖励方案,以促进可解释的多目标行为。这种方法有助于突出智能体在训练不同阶段优先考虑某些目标的原因。

• 可视化模块(“第二屏幕”):我们设计了一个实时界面的原型,在游戏直播旁绘制智能体状态、Q值或奖励分解图。这个“第二屏幕”可以帮助人类实时追踪策略更新,并检测次优或新兴策略。

• 用户研究框架:我们概述了一个研究设计方案——可能采用参与者间或参与者内设置——以比较多种解释格式(例如,确定性有限自动机与奖励分解)。我们的设计侧重于参与者如何在战略任务中解读、排序和信任智能体的行为。

• 与MIXTAPE整合:通过与宾夕法尼亚州立大学、Kitware公司和美国陆军研究实验室的合作,我们将这些强化学习和可解释人工智能组件嵌入到一个统一平台中,该平台可扩展到未来的多领域或高风险应用。

通过应对算法和面向用户的双重挑战,我们展示了战略领域的强化学习系统如何能够更加透明和具备协作性——将先进的机器学习能力与人类能够理解和信任的清晰、可操作的解读相结合。