真实世界中的大语言模型(LLM)往往被过度包装为令人生畏的学术产物,或者是某种神奇的生产力工具 。但这两种视角在技术面试中都毫无帮助 。面试官真正寻找的,是那些能够清晰解释分词(Tokenization)、注意力机制(Attention)、检索(Retrieval)、提示(Prompting)、微调(Fine-tuning)以及模型部署如何在生产约束下协同工作的工程师 。 今天,我将结合最新的《2026语言模型面试手册》(Language Models Interview Handbook),为大家深度拆解大模型时代的工程实践与面试核心逻辑。这不仅是一份面试指南,更是一份从算法研究走向复杂系统设计的系统工程全景图 。

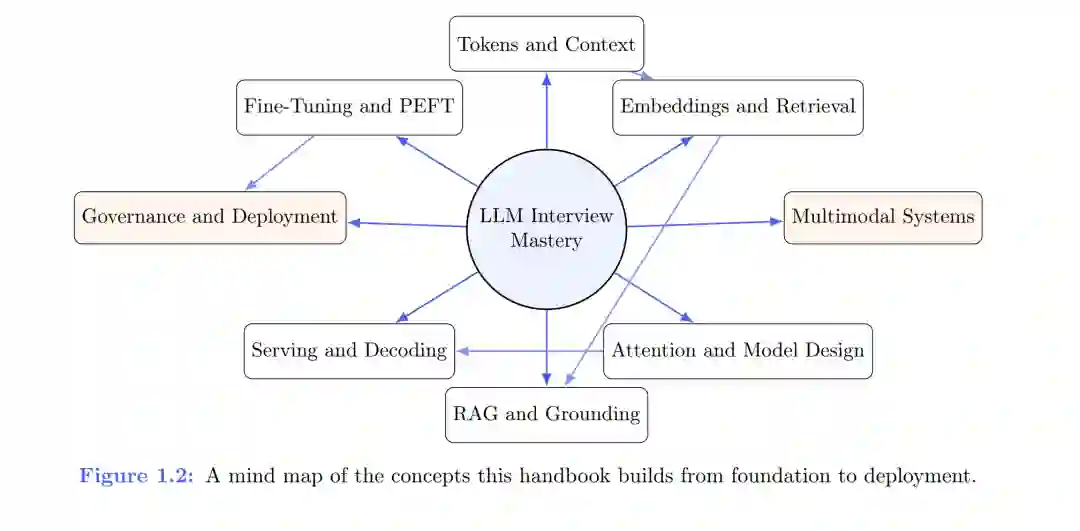

大语言模型(LLM)通常被描述为令人望而生畏的研究产物,或是被神化为高效的生产力工具。然而,在真实的面试场景中,这两种定性均无助益。面试官更青睐能够解释分词(Tokenization)、注意力机制(Attention)、检索、提示工程(Prompting)、微调以及部署如何在生产约束下协同工作的候选人。本手册经修订,旨在直接满足这一需求。 全书现由 16 个章节和 151 道面试题组成,进一步强化了对底层基础、职业路线规划、架构图解、重点章节总结、代码演练以及面试定位的侧重。新增的开篇章节界定了 LLM 的定义、领域的演进趋势、学习序列的构建,以及如何在生成式人工智能(GenAI)岗位中进行自我定位。随后的章节构建了技术基石:涵盖 Token、嵌入(Embeddings)、注意力机制、预训练及模型家族。中年章节深入探讨分类、主题发现、检索、RAG 以及提示工程。后续章节则覆盖了多模态系统、嵌入优化、参数高效微调(PEFT)、训练数学逻辑、解码、模型服务(Serving)以及生产环境部署。 每个章节现均包含两项精心设计的面试辅助工具:“面试锚点(Interview Anchor)”部分阐述了优秀候选人在口头回答时应强调的核心重点;“面试速查表(INTERVIEW CHEATSHEET)”面板则将这些内容转化为简洁的论点、权衡方案(Trade-offs)及潜在风险点(Red flags),便于在技术初筛、现场面试或离线技术测验前快速复习。 本手册的目标并非单纯为了记忆,其更高层次的目标是帮助你展现出作为一名工程师的专业素养:能够基于底层原理进行推演,针对特定负载选择合适的工具,清晰地阐述失效模式(Failure modes)并论证权衡取舍。这正是“机械背诵术语”与“展现真实技术判断力”之间的本质区别。

Chapter 1

引言、基础与LLM职业路线图

Introduction, Foundations, and Career Roadmap for LLMs Chapter 2

Token、分词与上下文窗口

Tokens, Tokenization, and Context Windows Chapter 3

嵌入与语义表示

Embeddings and Semantic Representations Chapter 4

Transformer架构、注意力机制与位置推理

Transformer Architecture, Attention, and Positional Reasoning Chapter 5

预训练目标、模型家族与经典对比

Pretraining Objectives, Model Families, and Classical Comparisons Chapter 6

大语言模型分类

Classification with Large Language Models Chapter 7

主题建模、聚类与规模化主题发现

Topic Modeling, Clustering, and Theme Discovery at Scale Chapter 8

大语言模型系统的检索基础

Retrieval Foundations for Large Language Model Systems Chapter 9

生产级RAG架构与接地回答

Production RAG Architectures and Grounded Answering Chapter 10

提示、上下文学习与LLM编排

Prompting, In-Context Learning, and LLM Orchestration Chapter 11

多模态大语言模型

Multimodal Large Language Models Chapter 12

定制嵌入与检索优化

Custom Embeddings and Retrieval Optimization Chapter 13

微调、PEFT与适应策略

Fine-Tuning, PEFT, and Adaptation Strategies Chapter 14

优化与语言模型数学基础

Optimization and Math Foundations for Language Models Chapter 15

文本生成、解码与规模化服务

Text Generation, Decoding, and Serving at Scale Chapter 16

架构、扩展与实际部署

Architectures, Extensions, and Practical Deployment

第一部分:启程——建立正确的“世界观”

**第一章:Introduction, Foundations, and Career Roadmap

任何一次成功的面试,都不是从背诵模型名称开始的。手册开篇就为我们定下了基调:LLM不是产品,它是产品中的一个引擎。

面试官真正想测试什么?

你是否能把LLM解释成一个工程系统,而不是一个孤立的“研究级”流行词? * 强者的答案模式:

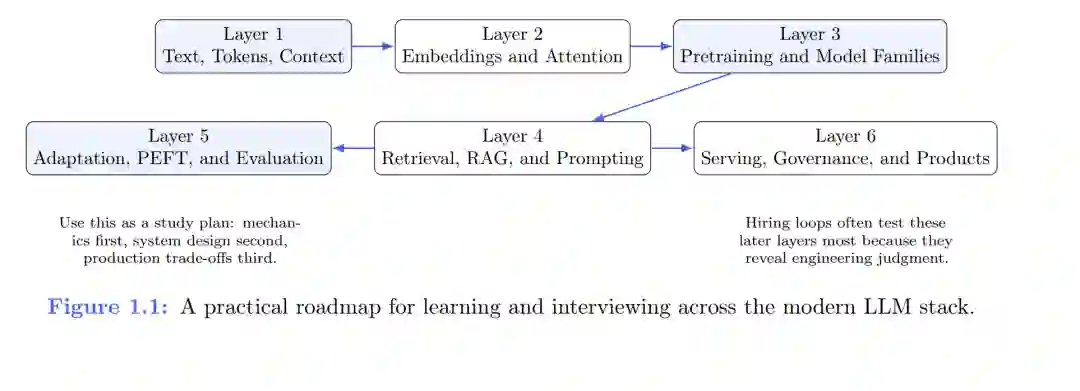

定义:LLM本质上是一个预训练好的“下一个词预测器”。 1. 系统化:它的价值,体现在被嵌入到检索(Retrieval)、工具调用(Tool-use)、评估(Evaluation)和交付(Delivery) 这个更大的工作流中。 1. 权衡:所有的技术选择,都是灵活性、成本与风险之间的权衡。 * 本章的灵魂:它为全书铺设了分层学习路线图:从文本基础与模型机制,到检索如何改变上下文质量,再到适应与部署。这不仅是学习顺序,也是你在简历和面试中展示自己时,最清晰的“叙事结构”。

第二部分:基石——理解模型的“语言”与“思想”

**第二章:Tokens, Tokenization, and Context Windows

“Tokenization is where human language becomes model compute.” —— 手册第二章金句 * Q1: 什么是Token?它为什么是LLM中真正的计算单元?

核心洞察:Token是连接人类文本和机器计算的桥梁。它决定了成本(API计费)、延迟(序列长度影响速度)、上下文窗口(能放多少信息) 和检索粒度(如何切分文档)。 * 关键对比:

BPE(Byte-Pair Encoding):通过合并高频子词,解决了“未登录词”问题,是GPT系列的基础。 * SentencePiece:不依赖空格分词的框架,对多语言和代码友好,是LLaMA等模型的选择。 * 工程实践:“预算思维”。一个合格的工程师会为系统指令、工具、输出长度预留足够的token空间,而不是天真地认为“长上下文”意味着可以无限往里塞内容。

**第三章:Embeddings and Semantic Representations

如果说Token是模型读到的“字母”,那么Embedding就是模型理解的“意义”。 * 核心问题:为什么Embedding让语义搜索成为可能?

答案:它将离散的文本映射到连续的向量空间。在这个空间里,“医生薪资”和“医师待遇”这两个在字面上毫无重叠的词,会因为语义相似而成为“邻居”。 * 关键概念辨析:

Bi-Encoder:分别对Query和Document编码,速度快,可预计算索引。是召回阶段的主力。 * Cross-Encoder:将Query和Document拼接起来一起编码,交互更充分,准确性更高。是精排阶段的不二选择。

Bi-Encoder vs. Cross-Encoder: * Hubness & Anisotropy:向量空间中的“马太效应”。少数向量会成为很多查询的“万金油”邻居,拉低检索质量。这提示我们,需要对Embedding空间进行校准,而非盲目相信距离。

第三部分:核心——揭秘Transformer的魔法

**第四章:Transformer Architecture, Attention, and Positional Reasoning

这是面试的必考题,也是最容易暴露“背书痕迹”的地方。 * Q22: 用简单的话解释什么是自注意力(Self-Attention)?

强者的比喻:它就像一个信息路由和聚合系统。每个词都向所有词(包括自己)发出一个“Query”,问:“你们中谁对我理解当前语境最重要?” 其他词用“Key”来响应。模型计算出权重后,再把所有词对应的“Value”(即它们携带的信息)按权重混合,最终每个词都获得了一个融合了全句信息的、上下文感知的新表达。 * Q24: 为什么需要多头注意力(Multi-Head Attention)?

答案:一个“头”可能专注于语法结构,另一个头可能专注于指代消解(如“它”指的是“狗”),另一个头可能专注于长距离依赖。多头的本质是让模型从多个维度同时理解文本。 * 核心工程点:KV Cache。在生成时,模型需要反复关注之前的所有token。KV Cache把之前计算好的Key和Value缓存起来,避免了重复计算,是生成加速的最关键优化。

**第五章:Pretraining Objectives, Model Families, and Classical Comparisons

模型家族的选择,由它的训练目标决定。 * Q32: 自回归模型(Autoregressive)和掩码语言模型(Masked LM)有何不同?

自回归模型(如GPT):从左到右,预测下一个词。天生擅长生成和续写。 * 掩码模型(如BERT):随机遮挡一些词,让模型从左右上下文去“填空”。天生擅长理解、分类和表征学习。 * Q38: 什么是基础模型(Foundation Model)?

答案:它是一类通用的、在广泛数据上预训练的模型。它不再是只做一件事的“窄模型”,而是可以被“微调”、“提示”、“检索”等方式适配到无数下游任务的通用底座。

第四部分:实战——构建可信、可控的AI系统

**第六章:Classification with Large Language Models

分类是LLM最被低估的能力之一,但选择策略比模型本身更重要。 * Q42: 何时用提示(Prompting),何时用微调(Fine-tuning)?

提示(Prompting):当标签变化快、数据少、或需要模型同时输出理由时。它的优势是灵活性。 * 微调(Fine-tuning):当标签稳定、数据量大、对延迟敏感时。它的优势是专业化和成本控制。 * 核心提醒:“Human-in-the-loop”。当一个分类决策涉及高风险(如医疗、金融)或模型信心不足时,请引入人工审核。这并非系统弱点,而是成熟的架构设计。

**第七章:Topic Modeling, Clustering, and Theme Discovery at Scale

当我们需要从海量无标签数据中发现未知的结构时,主题建模就登场了。 * Q51: 主题建模和分类有何不同?

分类是监督学习,我们有已知的标签。 * 主题建模是无监督学习,我们从数据中发现隐藏的主题。 * 现代实践:Embedding + Clustering + LLM。

Embedding:将每篇文档转为向量。 1. Clustering:用K-means或HDBSCAN等算法,在向量空间中寻找自然聚集的文档群。 1. LLM:让大模型分析每个群中的代表性文档,并为这个主题“起一个名字”,如“登录失败问题”、“账单支付纠纷”。

**第八章 & 第九章:Retrieval Foundations & Production RAG Architectures

这是全书最核心的章节之一,定义了现代LLM应用的“记忆”模式。 * Q61: 什么是RAG?

定义:检索增强生成。在模型生成答案前,先从一个外部知识库(如向量数据库)中检索相关信息,并将其作为“上下文”提供给模型。 * 目标:解决模型“闭卷”考试下的幻觉问题,让答案可溯源、可更新。 * Q71: Naive RAG 和 Production RAG 的区别?

Naive RAG:检索->拼接->生成。 * Production RAG:Naive RAG + 查询改写(Query Rewriting) + 元数据过滤(Metadata Filters) + 重排序(Reranking) + 引用溯源(Citation) + 缓存(Caching) + 权限控制(Permissions) + 拒绝回答策略(Abstention)。

**第十章:Prompting, In-Context Learning, and LLM Orchestration

提示工程,本质是“接口设计”。 * Q81: 系统消息(System)、用户消息(User)、工具消息(Tool)的角色?

System:定义角色、政策、输出格式。如:“你是一个专业的客服助手,总是用礼貌且简洁的语言回答,只引用提供的文档内容。” * User:传递用户的具体需求。 * Tool:传递来自外部系统(如API、数据库)的结构化证据。 * Q88: 什么是提示注入(Prompt Injection)?

定义:恶意用户或外部内容,通过巧妙构造的文本,让模型忽略系统预设的指令。 * 防御:架构防御。将用户输入和系统指令视为不同信任域的文本,通过工具调用、沙箱等方式进行隔离,而非仅靠提示词中的“请忽略以下内容”。

第五部分:进阶——面向未来的前沿与部署

**第十一章:Multimodal Large Language Models

真正的“世界模型”需要理解多种模态。 * Q92: 常见的图文多模态架构?

模式:视觉编码器 + 投影器 + 语言模型。视觉编码器(如CLIP的Vision Transformer)将图像转为向量,投影器将其“翻译”成语言模型能理解的token,然后语言模型在文本和图像token的混合序列上进行生成。 * Q94: 什么是视觉定位(Visual Grounding)?

核心:确保模型“所言”与“所见”一致。一个“接地”的多模态模型在看到一张长颈鹿的图片时,说“这是一只长颈鹿”,而不是仅仅从文本概率中猜出“动物园”。

**第十二章:Custom Embeddings and Retrieval Optimization

当通用Embedding在垂直领域“失灵”时,需要定制。 * Q103: 为什么训练检索Embedding时,需要“难负例”(Hard Negatives)?

比喻:教孩子认识“猫”和“狗”,光拿“猫”和“苹果”来对比,孩子很容易区分。但如果拿“老虎”或“猞猁”来对比,孩子才能真正掌握“猫”的本质特征。难负例就是那些和正例(相关文档)非常相似,但实际不相关的文档。它迫使模型学习更精细的边界。 * 优化阶梯:先优化数据清洗、分块策略,再尝试重排序,最后才考虑训练自定义Embedding。这是工程原则。

**第十三章:Fine-Tuning, PEFT, and Adaptation Strategies

如何将通用模型训练成“专家”。 * Q112: LoRA 和 QLoRA 的区别?

LoRA(Low-Rank Adaptation):在冻结的模型权重旁边,插入一个极小的、可训练的低秩矩阵。它只更新这个“小插件”,实现微调。 * QLoRA:在LoRA的基础上,进一步将冻结的基座模型量化到4-bit。这使得在单张消费级显卡上,也能微调百亿、千亿参数级别的模型。 * Q117: 什么是灾难性遗忘(Catastrophic Forgetting)?

定义:模型在过度学习新任务时,“忘记”了之前学到的、对通用任务有帮助的能力。 * 缓解:在微调数据中混合旧数据、使用LoRA这类参数高效方法、早停(Early Stopping)。

**第十四章:Optimization and Math Foundations

面试官常通过数学问题来考察你的深度,避免你成为“调包侠”。 * Q124: 为什么交叉熵(Cross-Entropy)是语言模型的标准损失函数?

答案:它衡量的是模型预测的概率分布和真实标签分布(通常是一个独热向量)之间的差距。它天然适配Softmax输出,梯度良好,且最小化交叉熵等价于最大化似然(MLE)。 * Q131: 残差连接和层归一化如何帮助解决梯度消失?

残差连接:为梯度提供了“高速公路”,让信号可以直接传回前面的层。 * 层归一化:稳定了每一层的激活值分布,让优化过程更平滑,避免参数更新幅度过大或过小。

**第十五章:Text Generation, Decoding, and Serving at Scale

让模型“开口说话”的艺术。 * Q132: 温度(Temperature)、Top-k、Top-p如何改变输出?

温度:控制概率分布的“尖锐”程度。温度低 → 高概率词更突出 → 输出更确定;温度高 → 概率分布更平坦 → 输出更多样。 * Top-p(核采样):从累积概率超过p的token集合中采样。它能动态地根据分布形态,决定候选词的数量,是目前最受欢迎的采样策略。 * Q141: 在系统设计题中,如何描述一个可扩展的LLM生成服务?

答案:一个生产级的服务,包含请求路由、身份验证、提示组装、检索/工具调用、模型推理(带KV Cache)、流式传输、安全审查、日志监控、缓存、AB测试和回滚机制。

**第十六章:Architectures, Extensions, and Practical Deployment

超越模型本身,思考系统架构和治理。 * Q142: 什么是混合专家模型(MoE)?

定义:用多个“专家”子网络替代单一的稠密前馈网络,并通过一个“门控网络”决定每个token由哪些专家处理。它实现了**“参数规模巨大,但计算成本可控”**的稀疏激活。 * Q150: 为什么LLM部署中,可解释性和隐私很难?

可解释性难:模型是“黑箱”,我们难以知道是“哪条路径”导致了某个输出。 * 隐私难:提示词可能包含用户敏感数据,检索过程可能涉及机密文档,而模型有“记忆”和“泄露”的风险。 * 对策:访问控制、数据最小化、严格的日志与审计是架构设计的必要组成部分,而非后期补救。

结语:面试是场关于“判断力”的对话

回到文章开头的问题:面试官到底在寻找什么? 他们寻找的不是一个背诵术语的机器,而是一个能回答以下问题的工程师: * “这个系统上线后,在什么情况下会崩溃?” * “你是如何权衡成本与延迟的?” * “当用户数据分布发生漂移时,你的系统如何发现和应对?”

这本《Language Models Interview Handbook》的价值,正在于此。它没有止步于提供答案,而是通过150多个问题、系统的目录结构、以及贯穿始终的“Interview Anchor”和“Cheatsheet”,试图为我们构建一套完整的、自洽的、从第一性原理出发的工程判断框架。 希望这篇基于其目录的深度解读,能帮助你更好地驾驭这本“红宝书”,在真实的面试和工程实战中,展现出你真正的价值。那才是技术判断力的终极体现。