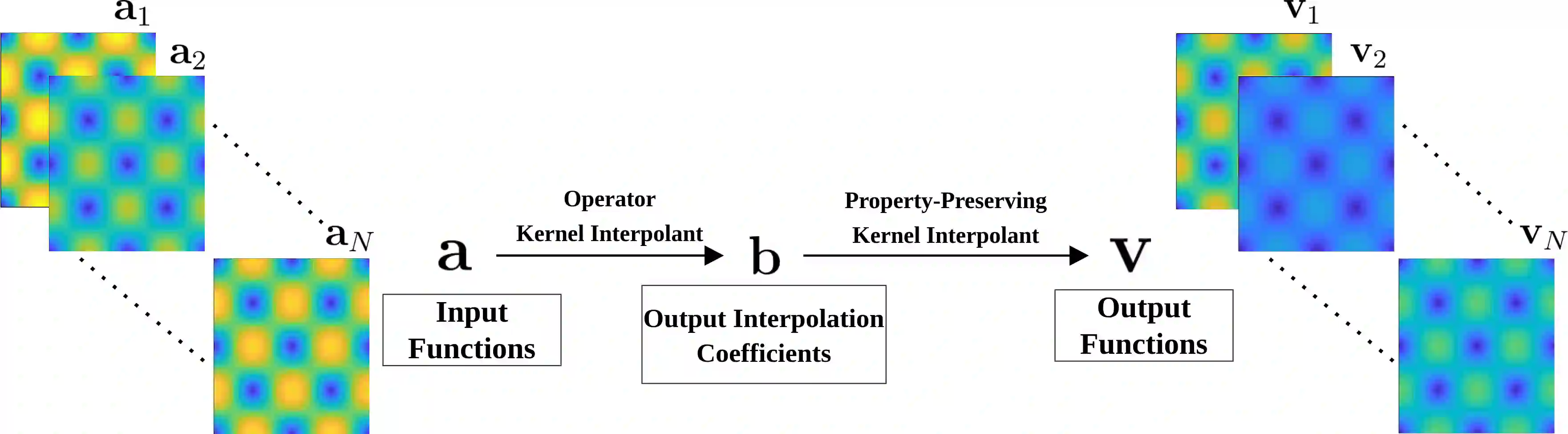

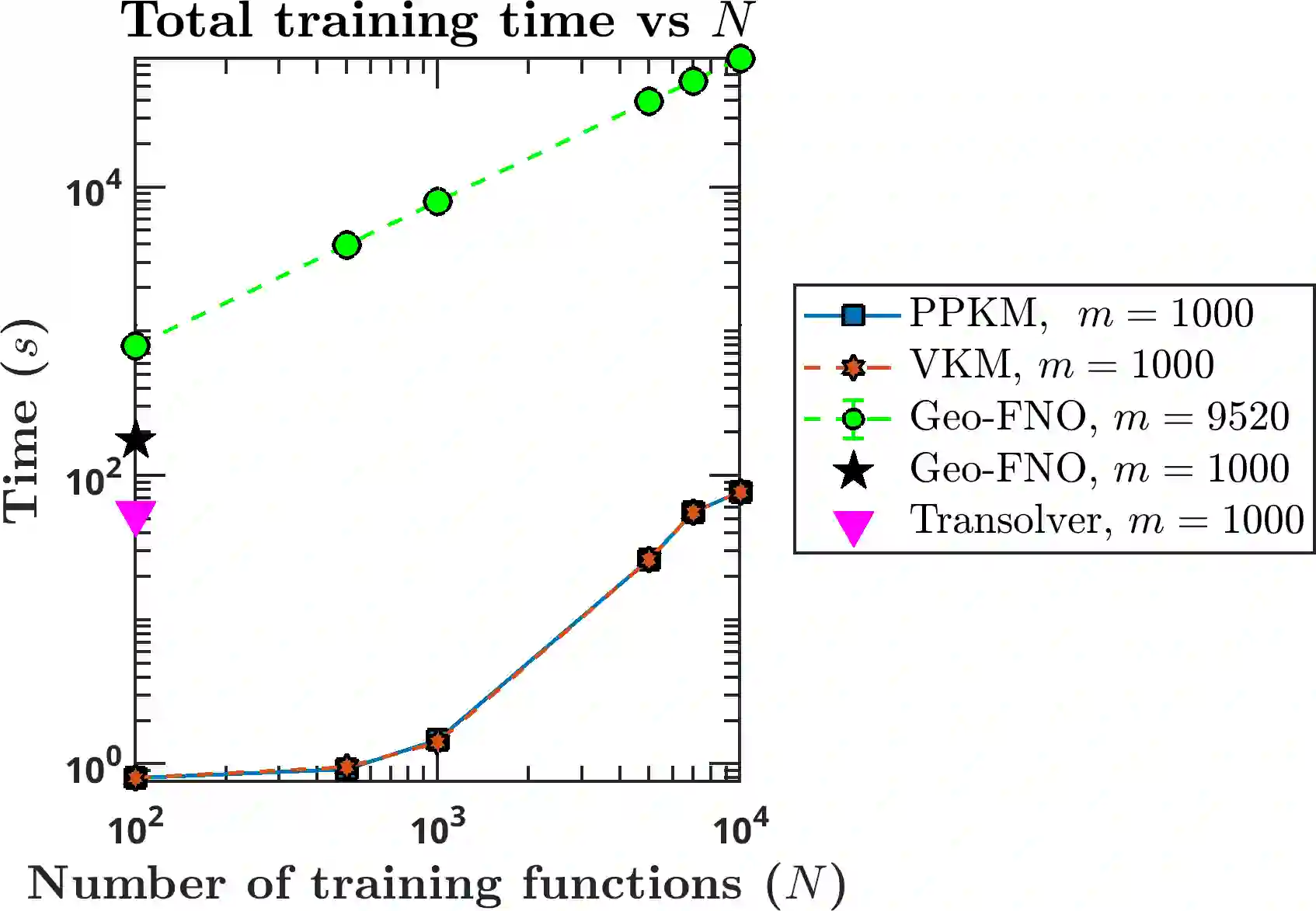

We present a novel property-preserving kernel-based operator learning method for incompressible flows governed by the incompressible Navier--Stokes equations. Traditional numerical solvers incur significant computational costs to respect incompressibility. Operator learning offers efficient surrogate models, but current neural operators fail to exactly enforce physical properties such as incompressibility, periodicity, and turbulence. Our kernel method maps input functions to expansion coefficients of output functions in a property-preserving kernel basis, ensuring that predicted velocity fields $\textit{analytically}$ and $\textit{simultaneously}$ preserve the aforementioned physical properties. Our method leverages efficient numerical linear algebra, simple rootfinding, and streaming to allow for training at-scale on desktop GPUs. We also present universal approximation results and both pessimistic and more realistic $\textit{a priori}$ convergence rates for our framework. We evaluate the method on challenging 2D and 3D, laminar and turbulent, incompressible flow problems. Our method achieves up to six orders of magnitude lower relative $\ell_2$ errors upon generalization and trains up to five orders of magnitude faster compared to neural operators, despite our method being trained on desktop GPUs and neural operators being trained on cutting-edge GPU servers. Moreover, while our method enforces incompressibility analytically, neural operators exhibit very large deviations. Our results show that our method provides an accurate and efficient surrogate for incompressible flows.

翻译:我们提出了一种新颖的基于核的属性保持算子学习方法,用于求解由不可压缩Navier-Stokes方程控制的不可压缩流动。传统数值求解器为保持不可压缩性需付出高昂计算代价。算子学习提供了高效的代理模型,但现有神经算子方法无法严格保持不可压缩性、周期性和湍流等物理属性。我们的核方法将输入函数映射到输出函数在属性保持核基上的展开系数,确保预测的速度场能够解析且同时保持上述物理属性。该方法结合高效数值线性代数、简单求根算法和流式处理技术,实现在桌面GPU上进行大规模训练。我们还给出了该框架的通用逼近理论结果,以及保守型和更现实型先验收敛速率。我们在具有挑战性的二维和三维、层流和湍流不可压缩流动问题上评估了该方法。与神经算子相比,我们的方法在泛化时相对ℓ₂误差降低达六个数量级,训练速度提升达五个数量级,尽管我们的方法仅在桌面GPU上训练,而神经算子使用前沿GPU服务器训练。此外,我们的方法解析地保持不可压缩性,而神经算子则表现出显著偏差。结果表明,我们的方法为不可压缩流动提供了精确高效的代理模型。