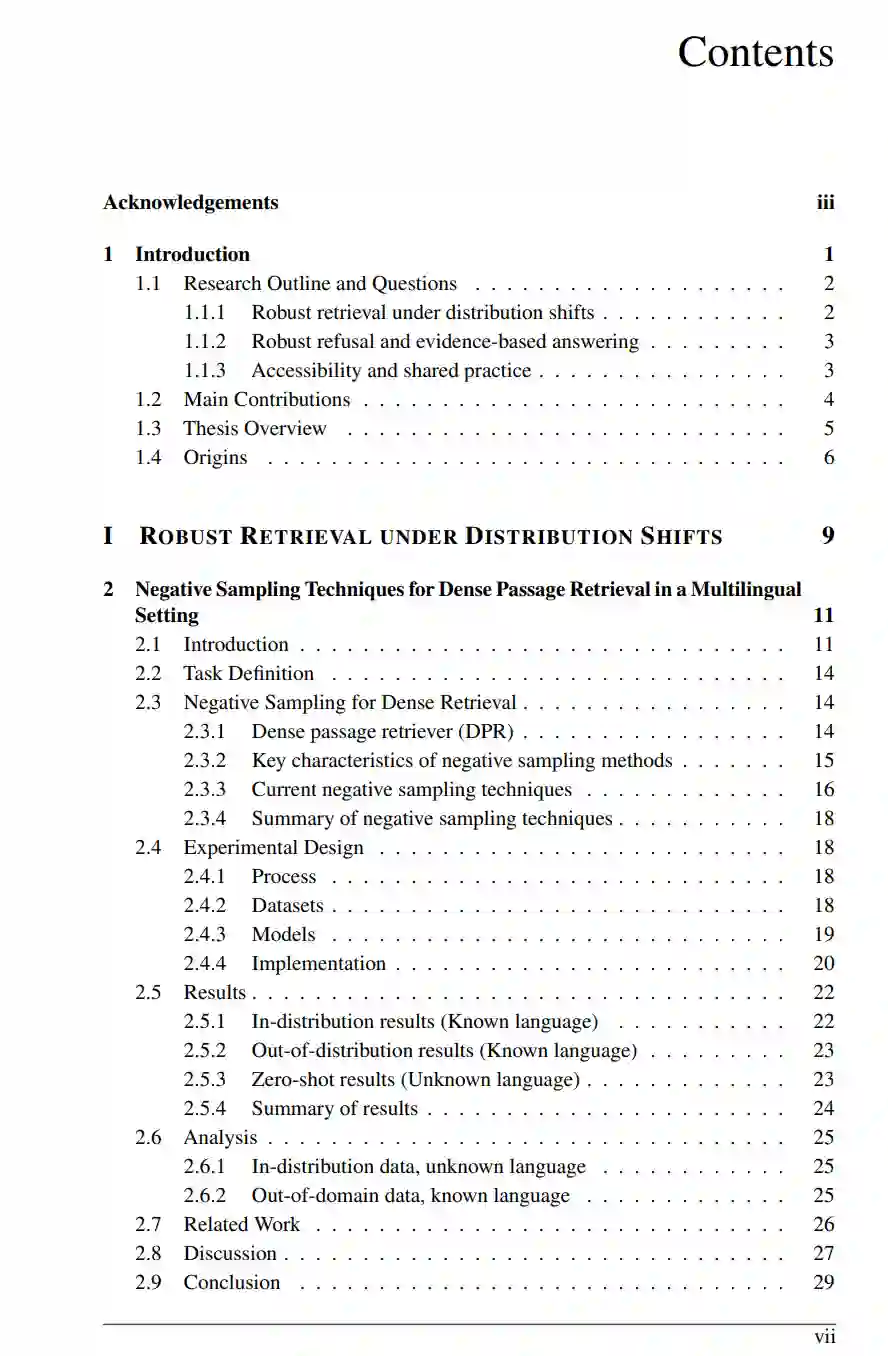

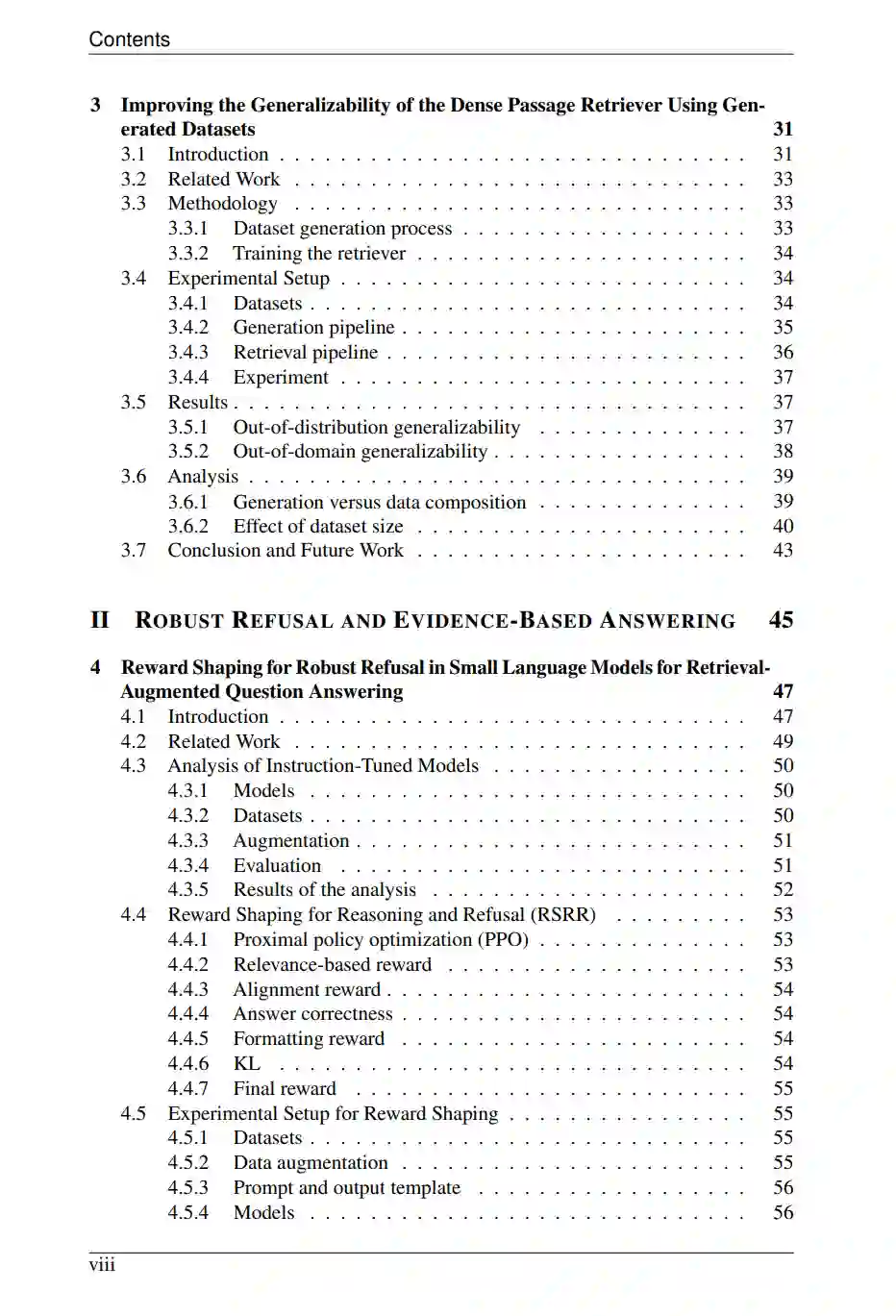

信息获取从未像现在这样便捷、迅速,却也从未如此脆弱。随着语言模型日益主导搜索与问答领域,检索信息与生成信息之间的界限已趋于模糊。旨在寻找相关文档的系统,现在通常会结合模型记忆与检索到的证据,缝合生成完整的回答与解释。尽管检索增强模型(RAG)使回答复杂问题变得轻而易举,但这种便利往往掩盖了其脆弱性:此类系统在测试条件与训练数据相似时表现最佳,而当二者不一致时则经常失效。 现代信息检索系统通常采用流水线架构(Pipeline Architecture),由检索器筛选候选文档,再由生成器根据这些文档生成回答。在这些系统中,检索与生成是紧密耦合的。实现可靠性能的关键在于两项要求:一是泛化性,即检索器在面对新数据集、新领域和新语言时依然有效;二是有据性,即生成器必须依据检索到的证据产出内容,并在证据缺失时拒绝回答。 本论文将这两项要求结合起来进行研究。文中考察了训练数据增强与负采样如何影响分布偏移下的稠密检索器,提出了增强跨领域及跨语言鲁棒性的方法,并研究了如何训练小型开源语言模型,使其能够基于检索到的证据进行推理,并在证据不足时拒绝回答。最后,本研究通过开源库 Simple Transformers 强调了技术的可及性,旨在降低构建与复现基于 Transformer 的检索及问答系统的门槛。

https://hdl.handle.net/11245.1/7817d7ad-bcf9-4517-8f18-2b620facd97d

成为VIP会员查看完整内容