融合辅助信息的学习范式:从语言建模到表格建模

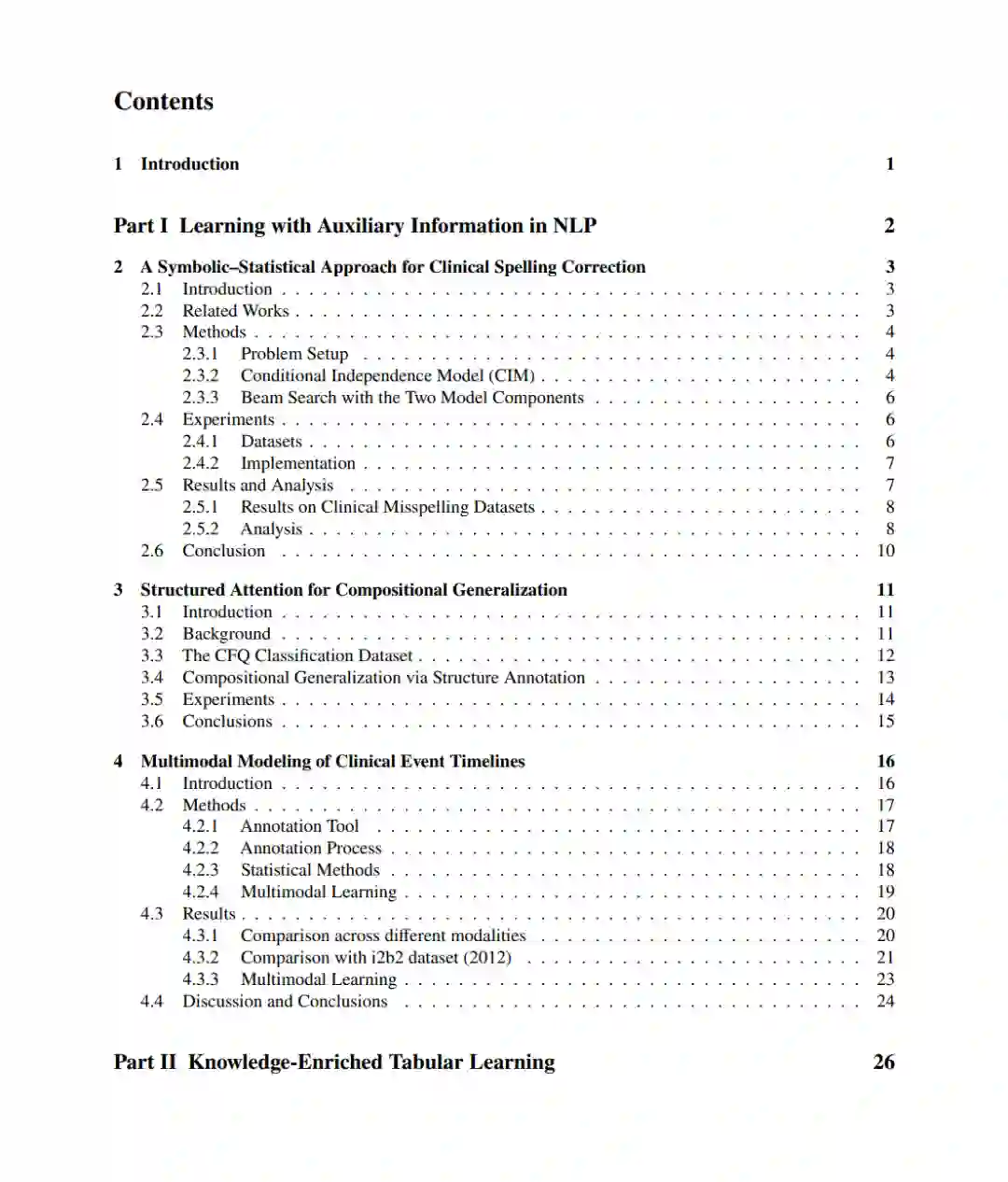

在过去十年中,深度学习模型通过在海量且高度同质化的数据集上训练日益庞大的架构,在众多机器学习任务中取得了显著进展。然而在实际应用中,这些模型往往忽略了现实世界数据中伴随的“额外”信息,而仅单纯依赖主数据模态进行泛化。本论文指出,可以系统地利用这类辅助信号,以提升模型的准确性、数据效率及可解释性。 论文的第一部分侧重于自然语言处理(NLP),并报告了三项研究。研究结果表明:(i) 通过将字符级语言模型与临床词典相结合,构建简单的符号-统计模型,能够有效提升嘈杂临床记录中的拼写纠错性能;(ii) 利用派生自语法解析树的结构化注意力掩码(Structural attention masks),可助力 Transformer 架构应对困难的组合泛化分割任务;(iii) 将出院小结与带时间戳的电子健康档案(EHR)表格进行关联,可进一步细化临床事件的时间线。 论文的第二部分转向表格数据领域,在该领域中,梯度提升树(Gradient-boosted trees)目前仍在线性基准测试中占据主导地位。首先,我提出了一种知识增强型框架,旨在将确定性信息注入表格学习器中;定义了用于编码列间关系的“概念核”(Concept kernels);并发布了一个包含列描述、嵌入向量及概念核的公共表格数据集基准。在此基础上,我提出了一种概念条件表格模型(Concept-conditioned tabular model),该模型将每个单元格表示为其数值与对应列语义嵌入的函数,并在扩展的数据集集合上对其进行了预训练。 综上所述,这些研究贡献旨在阐明如何将辅助领域知识转化为有效的归纳偏置。

成为VIP会员查看完整内容

相关内容

Arxiv

231+阅读 · 2023年4月7日

Arxiv

20+阅读 · 2023年2月1日