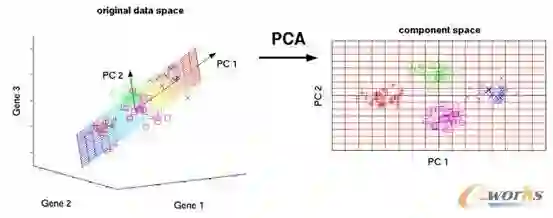

Sparse principal component analysis (SPCA) addresses the poor interpretability and variable redundancy often encountered by principal component analysis (PCA) in high-dimensional data. However, SPCA typically imposes uniform penalties on variables and does not account for differences in variable importance, which may lead to unstable performance in highly noisy or structurally complex settings. We propose SP-SPCA, a method that introduces a single equilibrium parameter into the regularization framework to adaptively adjust variable penalties. This modification of the L2 penalty provides flexible control over the trade-off between sparsity and explained variance while maintaining computational efficiency. Simulation studies show that the proposed method consistently outperforms standard sparse principal component methods in identifying sparse loading patterns, filtering noise variables, and preserving cumulative variance, especially in high-dimensional and noisy settings. Empirical applications to crime and financial market data further demonstrate its practical utility. In real data analyses, the method selects fewer but more relevant variables, thereby reducing model complexity while maintaining explanatory power. Overall, the proposed approach offers a robust and efficient alternative for sparse modeling in complex high-dimensional data, with clear advantages in stability, feature selection, and interpretability

翻译:稀疏主成分分析(SPCA)旨在解决主成分分析(PCA)在高维数据中常遇到的解释性差和变量冗余问题。然而,SPCA通常对变量施加统一的惩罚,并未考虑变量重要性的差异,这可能导致在高噪声或结构复杂的场景下性能不稳定。我们提出SP-SPCA方法,该方法在正则化框架中引入单一平衡参数,以自适应地调整变量惩罚。这种对L2惩罚的修改能够在保持计算效率的同时,灵活地控制稀疏性与解释方差之间的权衡。模拟研究表明,所提方法在识别稀疏载荷模式、过滤噪声变量以及保持累积方差方面,始终优于标准的稀疏主成分方法,尤其是在高维和噪声环境中。对犯罪和金融市场数据的实证应用进一步证明了其实际效用。在真实数据分析中,该方法选择了更少但更相关的变量,从而在保持解释力的同时降低了模型复杂度。总体而言,所提方法为复杂高维数据中的稀疏建模提供了一种稳健且高效的替代方案,在稳定性、特征选择与可解释性方面具有明显优势。