本文为多智能体决策系统开发了一个贝尔曼层面的框架,其中安全性、一致性及环境漂移下的鲁棒性通过全局可容许性约束来保证,而非通过局部激励或事后修正。基于贝尔曼共约的概念,将可容许贝尔曼算子推广到联合行动空间,并证明全局安全不变量可作为边界条件施加于状态-行动流形。这种边界定义方法保证了任何局部最优的智能体策略在构造上始终是全局可容许的,即使在非平稳环境动态下也是如此。由此产生的框架将多智能体安全与协调重新构建为贝尔曼算子本身的结构特性,为奖励塑造、屏蔽和分散式惩罚机制提供了一个原则性的替代方案。本文证明,在环境漂移下,贝尔曼优化与可容许性投影不可交换,这解释了约束马尔可夫决策过程及基于惩罚的安全性方法在多智能体系统中的结构性失效。

多智能体强化学习系统在局部决策与全局系统行为之间存在根本性的结构张力。个体智能体基于部分信息、局部目标和有限的观测能力优化策略,而其行动的后果则在联合环境层面展开。这种不匹配不仅仅是一个协调挑战,更反映了决策推理与环境演化之间更深层的二元性。

经典强化学习建立在贝尔曼最优性和动态规划原理之上,而最近关于多智能体系统的工作强调了通过局部激励或协调机制来强制实施全局安全的困难。标准的MARL安全性方法试图通过修改智能体端的推理来解决这种张力:通过奖励塑造、惩罚、拉格朗日约束或运行时修正机制。这些方法隐含地假设全局安全可以通过局部调整决策激励来恢复。然而,这类方法系统地无法提供鲁棒的保证,特别是在非平稳条件和环境漂移下,此时行动、奖励与结果之间的映射变得不稳定。这种失效的核心原因是结构性的。在多智能体系统中,安全性、一致性和规则遵从性并非个体决策的属性,而是所诱导的环境动态的属性。决策在局部做出,但其影响在全局组合,而最终导致约束违反的是环境——而非智能体。因此,将安全性视为局部决策规则的属性,混淆了两个截然不同的领域:对行动的推理与对其联合效应的管控。

本文提出以下论点:在多智能体系统中,安全性与一致性是边界现象,而非内部控制问题。

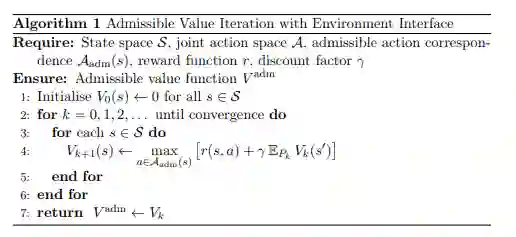

不局部修正智能体行为,而是将可容许性定义为对联合状态-行动效应空间的全局约束,并直接在贝尔曼算子层面强制实施。这将安全性从智能体端优化的属性转变为环境-决策接口本身的属性。贝尔曼共约通过将算子域限制在可容许的联合行动上,同时保持最优性、收缩性和不动点收敛性,从而将这种转变操作化。从概念上讲,该框架揭示了环境与决策推理之间的二元性。贝尔曼算子在两个领域之间进行调解:它将决策选择转化为预期的环境演化。通过约束算子而非策略更新,可容许性在该二元性的两侧得到对称实施。决策仅在那些环境影响可容许的行动上进行优化,并且只要环境漂移尊重相同的可容许性边界,就会被吸收。这种二元视角镜像了散度定理的逻辑:支配内部行为的全局不变量完全由边界条件决定。在当前设定中,可容许性定义了状态-行动流形上的一个边界,而贝尔曼共约确保由最优决策诱导的所有内部轨迹在构造上保持在此边界内。因此,安全性与一致性并非源于局部修正控制,而是源于决策推理与可容许环境动态的结构性对齐。

从这个角度看,所提出的框架与约束马尔可夫决策过程以及集中训练-分散执行范式都有着根本区别。约束马尔可夫决策过程将安全性视为施加在期望回报上的优化约束,从而将可容许性嵌入到智能体的目标中,而非嵌入到决策-环境交互的动态中。因此,约束马尔可夫决策过程中的约束满足是统计性的且依赖于策略,并可能在瞬态或环境漂移下被违反。而集中训练-分散执行方法则依赖于训练期间的集中评论器或共享信息来缓解非平稳性,但将可容许性强制执行留给了执行期间习得的协调模式或运行时机制。相比之下,贝尔曼共约在一个更根本的层面上运作:它约束贝尔曼算子本身,从而通过共享的可容许性边界使决策推理与环境演化保持一致。安全性与一致性不再是要学习、逼近或激励的属性,而是决策过程的结构不变量。这种算子层面的处理通过确保仅在那些诱导的环境效应可容许的行动上进行优化,解决了环境-决策二元性问题,从而产生了对分散化、学习动态和环境漂移保持不变性的全局保证。

现有的约束性表述,如约束马尔可夫决策过程,是在期望回报层面而非轨迹支撑上施加安全要求。

贡献。本文做出以下贡献:引入贝尔曼共约作为在多智能体系统中强制实施全局可容许性的算子级机制,将安全性从策略优化转移到决策-环境接口。本文证明,在环境漂移下,可容许性强制实施与贝尔曼优化不可交换,从而确立了与基于约束马尔可夫决策过程和惩罚的方法的形式分离。发展了一种可容许性拓扑,并证明可容许轨迹是前向不变的,从而在构造上产生边界定义的安全性与一致性。证明了最优可容许联合策略的存在性,并表明分散式执行无需运行时协调即可保持全局安全性与最优性。本文证明,保持可容许性的环境漂移在结构上被吸收,从而确保非平稳性下的鲁棒性。