人工智能正日益被用于增强和自动化网络空间行动,从而改变了恶意活动的规模、速度和可及性。这些转变引发了紧迫的问题:人工智能系统何时会引入不可接受或难以容忍的网络风险,以及应如何在危害大规模显现之前识别风险阈值。

近年来,产业界、政府和民间社会主体已开始尝试为先进人工智能系统阐明此类阈值,目的是指示模型何时能实质性地放大网络威胁——例如,通过自动化多阶段入侵、实现零日漏洞发现或降低复杂攻击所需的专业技能。然而,当前确定这些阈值的方法仍然零散且有限。许多阈值仅依赖于能力基准或狭窄的威胁场景,且与实证证据关联薄弱。

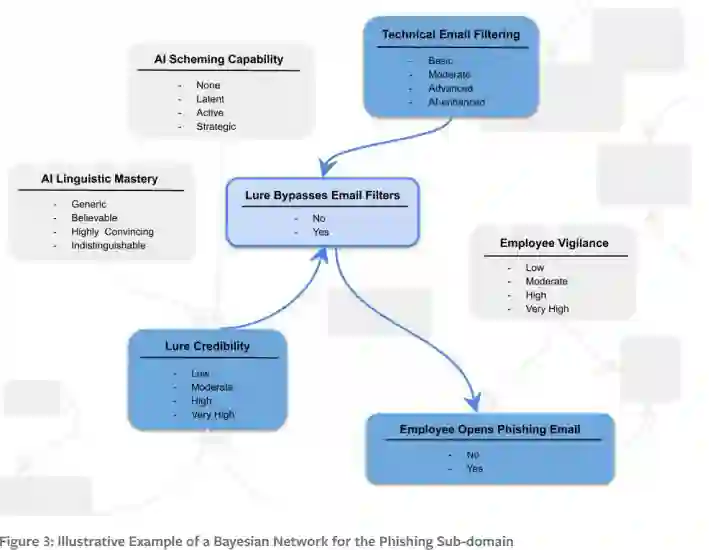

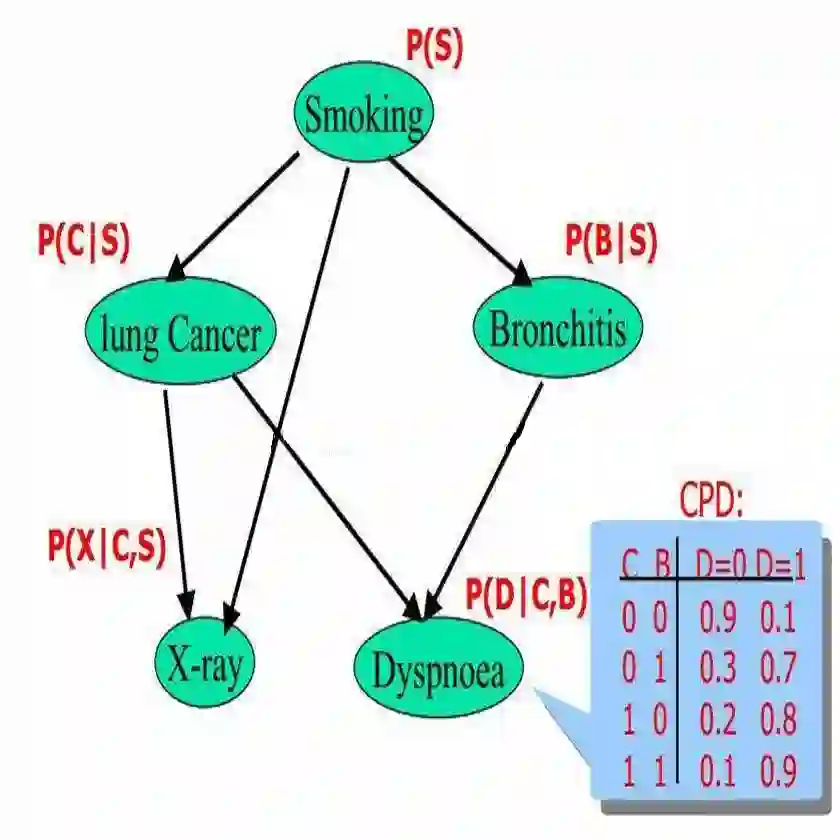

本文提出了一种结构化的方法来开发和评估人工智能网络风险阈值,该方法具有概率性、基于证据且可操作。在本文中,我们基于我们先前强调仅依赖能力评估之局限性的研究,做出了三项核心贡献。首先,我们分析了现有的行业网络风险阈值,识别了常见的阈值要素以及反复出现的方法学缺陷。其次,我们建议使用贝叶斯网络作为对人工智能赋能网络风险进行建模的工具,使其能够整合异构证据、明确表征不确定性,并在新信息出现时持续更新。第三,我们通过一个关于人工智能增强型网络钓鱼的重点案例研究来阐释此方法,展示如何将定性的威胁洞见分解为可度量的变量,并重新组合成结构化的风险估计,从而更好地捕捉人工智能如何改变攻击者行为和结果。

此项工作并非提出单一确定的阈值,而是提供了一条实用路径,将高层的风险关切转化为可度量、可监控的指标。这些指标可在人工智能赋能的网络风险演变过程中,为部署、缓解和监督决策提供信息依据。

成为VIP会员查看完整内容